如果你最近花了一些時間在測試 AI 影片工具,你大概已經注意到同一個問題:讓模型產生影片很容易,但要讓影片「照你想要的方式動起來」就難多了。這就是為什麼「動作控制」會開始變得重要。

很多人會搜尋一個AI 影片產生器,但實際需求通常更具體。創作者希望產品鏡頭是平滑向前滑動,而不是抖動;希望角色轉身自然,而不是漂移變形;希望有一個圖生影片流程,感覺是被「導演」出來的,而不是隨機生成。

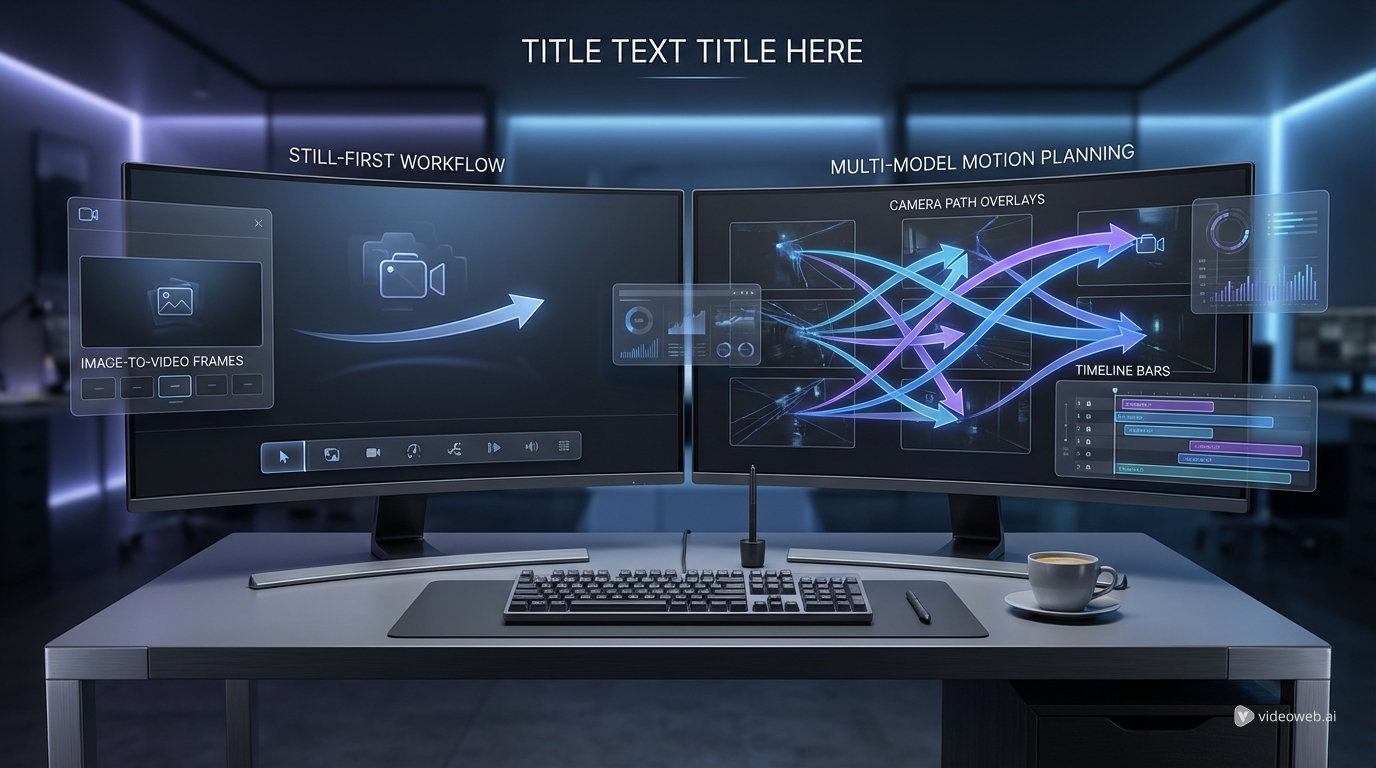

這也是為什麼比較 Zorq AI 和 VideoWeb AI 會變得有趣。兩者都能幫助你做動作驅動的 AI 影片,但他們從不同角度切入問題。Zorq AI 以「先靜態、後動畫」的流程設計為核心,而 VideoWeb AI 則著重在更廣泛的多模型系統,圍繞像是 Higgsfield Motion Control、Kling 2.6 和 Kling 3.0 等工具打造。

動作控制真正代表什麼意思

白話來說,「動作控制」就是你能告訴模型鏡頭應該怎麼動,而不是祈禱提示詞碰巧做到。這可以包含鏡頭運動方向、主體移動、節奏,以及前景與背景之間的關係。在短影片內容裡,這個差異非常巨大。

一般的提示詞可能要嘗試好幾次才會給你一個勉強可用的結果。動作控制流程的目的,就是從一開始就讓運動更「有意圖」,來減少這些嘗試次數。無論你是在做廣告、社群短片、吉祥物動畫,還是電影級測試,這都很重要。

像是 AI 影片動作控制、Kling AI、Higgsfield AI 這類關鍵字的興起,也反映了這個變化。使用者開始走出「泛用影片生成」,轉而追求更乾淨、更可控的運動表現。

Zorq AI:以靜態為先的動作流程

如果你的第一優先是「一致性」,Zorq AI 會很合理。它公開的標準流程,是先產生或確認一張靜態圖片,然後再把那個「精確畫面」轉成動態。聽起來很簡單,但這解決了 AI 影片裡最惱人的問題之一:你喜歡的那張圖,跟最後得到的影片之間的「漂移」。

對於需要和品牌團隊、客戶或內部單位協作的創作者來說,這種做法很實際。你可以先鎖定構圖,確保產品或角色的樣子正確無誤,再進入動畫階段。這種心態和許多偏「探索式」的影片平台截然不同。

Zorq AI 也公開強調 Kling 系列的動作控制,包括 Kling 2.6 Motion Control 和 Kling 3 Motion Control。它的價值不只是用到強大的影片模型,而是把這些模型包裝進一個更適合審核的流程裡。如果你的工作流程高度依賴「簽核」,這一點的重要性不亞於模型本身的品質。

VideoWeb AI:更開放的動作控制遊樂場

VideoWeb AI 更像是一個給創作者的工作空間,適合想要「多種選擇」的人。它不把所有事情都綁在一張鎖定的靜態圖上,而是呈現一個更廣泛的模型生態系。就動作控制來說,它最清楚的搭配是:用 Higgsfield Motion Control 規劃動作,再用 Kling 2.6 或 Kling 3.0 來渲染最終畫面。

這樣的組合之所以實用,是因為它把「意圖」和「輸出」分開來處理。Higgsfield 幫你定義動作路線,而 Kling 負責實際影片生成。對於想測試多種視覺風格、比較不同模型行為,或反覆打磨不同運動想法的創作者來說,這是很大的優勢。

VideoWeb AI 在動作控制之外也有更大的模型陣容,包括 Veo 3.1、Vidu Q3、Runway Gen 4,以及 Seedance 2.0。如果你不想讓整個管線被單一渲染風格綁死,它會更適合作為長期的工作空間。

真正的差別:控制哲學

比較這兩個平台,與其問哪一個「比較好」,不如問:「它們各自是為哪一種創作者而生?」

當「動作控制」是穩定製作流程的一部分時,Zorq AI 比較吃香。如果你在做產品影片、精緻的 UGC 廣告、品牌吉祥物,或需要客戶核准的短片,走「先靜態、再動畫」會更容易管理。你在進入動畫前,先盡可能把不確定性降到最低。

當「動作控制」是創意測試流程的一部分時,VideoWeb AI 會更對味。如果你想嘗試不同鏡頭路徑、比較模型,或實驗各種不同的運動感,它的模型多樣性就會變成真正的優勢。它給了你更多探索空間,特別是當你的工作比較偏「迭代創作」而不是「層層審核」時。

並排比較

| 類別 | Zorq AI | VideoWeb AI |

|---|---|---|

| 主要動作思維 | 先產生靜態畫面,再加入動畫 | 先規劃運動,再用多模型渲染 |

| 最適合的場景 | 品牌內容、需審核的專案、產品短片 | 創作者、測試者、多模型工作流程 |

| 動作控制技術堆疊 | 以 Kling 為核心的動作控制 | Higgsfield 動作規劃 + Kling 系列渲染 |

| 強項 | 視覺一致性與審核流程 | 彈性高、模型選擇多 |

| 上手難度 | 較容易理解 | 較適合想要更多選擇、願意摸索的使用者 |

| 理想工作流程 | 先審核畫面,再加入動作 | 先設計運動,再比較不同輸出結果 |

實際使用時,哪一個感覺比較強?

在產品廣告與精緻短影音內容這一塊,Zorq AI 的訴求相對乾淨。當每一次修改都會造成時間成本與溝通成本時,先鎖定靜態畫面再開動畫是很合理的。只要產品角度、光線或角色臉部表現必須保持一致,這種流程會讓人比較安心。

在電影感短片、概念探索,以及喜歡同時嘗試多種模型家族的創作者身上,VideoWeb AI 的吸引力會更大。動作規劃加上模型選擇的組合,給了你更大的創作空間。這不一定代表你會更快完成作品,但往往能讓你更精準調出一個鏡頭的「感覺」。

對於舞蹈、肢體動作強烈或表演導向的內容,哪個比較好要看你的目標。如果你需要可預測、品牌安全的輸出,Zorq AI 可能更好管理;如果你想實驗各種運動風格,看看不同渲染引擎如何詮釋同一個鏡頭概念,VideoWeb AI 會比較有優勢。

最後結論

如果要用最短的版本來總結,就是:面向想要穩定「由靜到動」流程的創作者,Zorq AI 較為合適;而面向需要更廣泛動作控制工具箱的創作者,VideoWeb AI 會是更好的選擇。

Zorq AI 的感覺比較偏「編輯導向」;VideoWeb AI 的感覺則比較偏「探索導向」。

這並不代表有一個工具是「絕對比較好」的,而是它們在解決不同的痛點。如果你的主要問題是視覺一致性和審核摩擦,Zorq AI 會比較容易被納入流程;如果你的主要問題,是想在多種工具與模型之間找到最對味的動作語言,VideoWeb AI 則提供了更大的操作空間。

在到處都是「泛泛 AI 影片」承諾的市場裡,這樣的區別反而變得格外有價值。

VideoWeb AI 上值得一試的工具

- Higgsfield Motion Control:用來設計更乾淨的鏡頭運動與更有導演感的鏡頭行為。

- Kling 2.6:適合想要有動作意識、畫面精緻的短片渲染。

- Kling 3.0:較新的 Kling 工作流程,適合追求更電影感的輸出。

- Veo 3.1:用於較長時長、寫實風格的生成,以及與聲音節奏對齊的影片創作。

- Vidu Q3:給想在同一工作空間裡多用一款高階影片模型的創作者。

- Runway Gen 4:擅長生成短、精緻且具強視覺一致性的電影感片段。

- Seedance 2.0:適合想在同一平台比對當前主流影片模型表現的使用者。

相關文章

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results