Se hai passato del tempo a testare strumenti di video AI ultimamente, probabilmente hai notato lo stesso problema: ottenere che un modello generi un video è facile, ma farlo muovere come vuoi tu è molto più difficile. È qui che il controllo del movimento comincia a diventare importante.

Molte persone cercano un generatore di video AI, ma il bisogno reale di solito è più specifico. I creator vogliono una ripresa di prodotto che scorra in avanti invece di tremare. Vogliono che un personaggio si giri in modo naturale invece di deviare fuori modello. Vogliono un workflow da immagine a video che sembri diretto, non casuale.

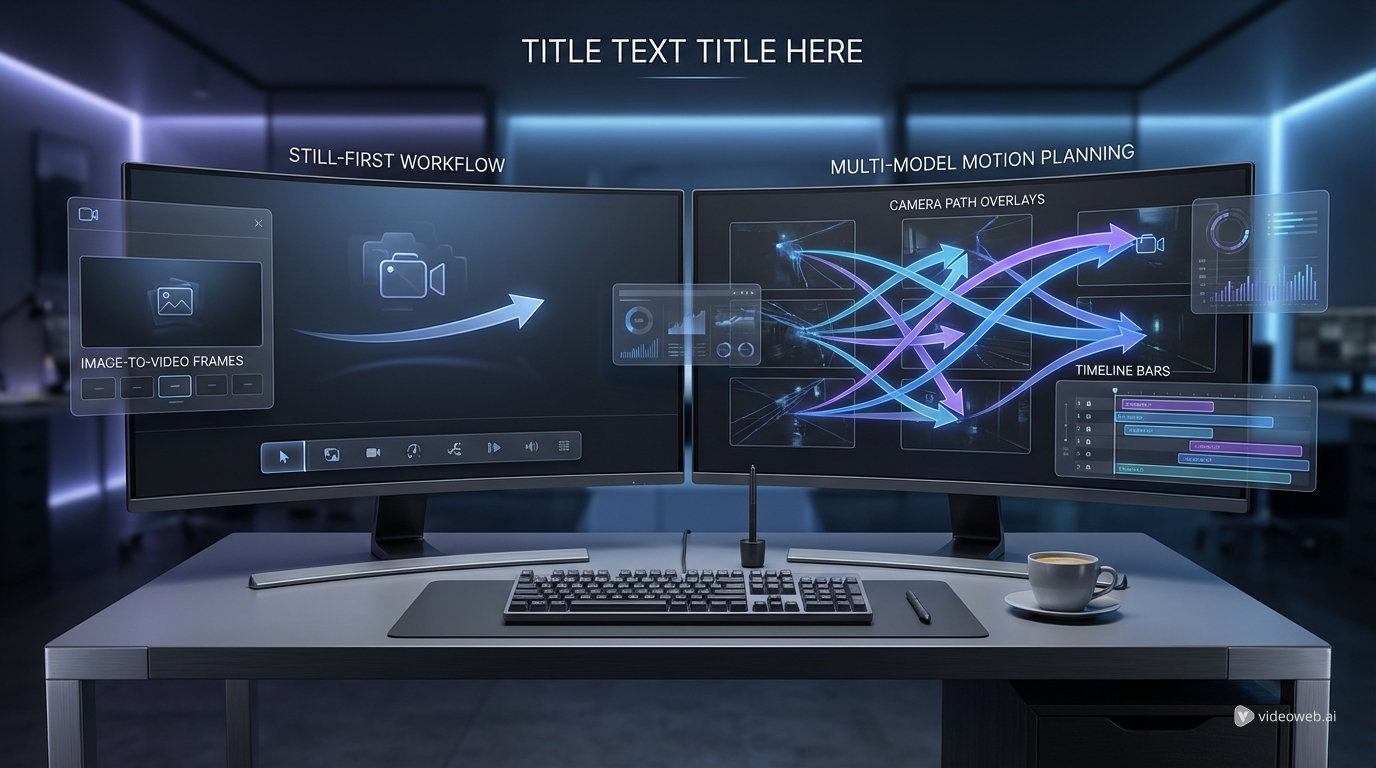

Per questo è interessante confrontare Zorq AI e VideoWeb AI. Entrambi possono aiutare con video AI guidati dal movimento, ma affrontano il problema da angolazioni diverse. Zorq AI è costruito attorno a un workflow incentrato prima sull’immagine statica, mentre VideoWeb AI punta su un sistema multi-modello più ampio, basato su strumenti come Higgsfield Motion Control, Kling 2.6 e Kling 3.0.

Cosa significa davvero controllo del movimento

In parole semplici, controllo del movimento significa dire al modello come la ripresa dovrebbe muoversi, invece di sperare che il prompt ci arrivi da solo. Questo può includere la direzione della camera, il movimento del soggetto, il ritmo e la relazione tra primo piano e sfondo. Nei contenuti brevi, questa differenza è enorme.

Un prompt normale potrebbe darti un risultato utilizzabile dopo vari tentativi. Un workflow con controllo del movimento è pensato per ridurre questi tentativi rendendo il movimento più intenzionale fin dall’inizio. Questo conta sia che tu stia creando annunci, clip social, animazioni di mascotte o test cinematografici.

L’interesse per termini come controllo del movimento per video AI, Kling AI e Higgsfield AI riflette anche questo cambiamento. Gli utenti stanno andando oltre la semplice generazione di video generici e cercano un controllo più pulito.

Zorq AI: un workflow sul movimento incentrato sull’immagine statica

Zorq AI ha più senso se la tua prima priorità è la coerenza. Il suo workflow pubblico enfatizza la generazione o l’approvazione prima di un’immagine statica, per poi trasformare proprio quella in movimento. Sembra semplice, ma risolve uno dei problemi più fastidiosi del video AI: lo scostamento tra l’immagine che ti è piaciuta e il video che hai ottenuto.

Per i creator che lavorano con team di brand, clienti o processi di approvazione interni, questo approccio è pratico. Puoi bloccare prima la composizione, assicurarti che il prodotto o il personaggio appaiano corretti, e solo dopo animare. È una mentalità molto diversa dallo stile più esplorativo di molte piattaforme video.

Zorq AI mette anche in evidenza pubblicamente il controllo del movimento basato su Kling, inclusi Kling 2.6 Motion Control e Kling 3 Motion Control. Il valore qui non è solo l’uso di modelli video potenti, ma il fatto di inserirli in un processo più adatto alle approvazioni. Se il tuo workflow dipende dal “sign-off”, questo conta quanto e più della qualità grezza del modello.

VideoWeb AI: un playground più ampio per il controllo del movimento

VideoWeb AI sembra più uno spazio di lavoro per creator che vogliono opzioni. Invece di concentrare tutto su un fermo immagine bloccato, presenta un ecosistema di modelli più ampio. Per il controllo del movimento nello specifico, la sua configurazione più chiara è Higgsfield Motion Control per pianificare il movimento, quindi Kling 2.6 o Kling 3.0 per il rendering della ripresa finale.

Questa combinazione è utile perché separa l’intento dall’output. Higgsfield aiuta a definire il movimento, mentre Kling gestisce la generazione video vera e propria. Per i creator che vogliono testare più stili visivi, confrontare il comportamento dei modelli o iterare su idee di movimento differenti, questo è un grande vantaggio.

VideoWeb AI ha anche una gamma di modelli più ampia oltre il controllo del movimento, tra cui Veo 3.1, Vidu Q3, Runway Gen 4 e Seedance 2.0. Questo gli dà più valore come spazio di lavoro a lungo termine se non vuoi che la tua pipeline sia legata a un unico stile di rendering.

La vera differenza: filosofia del controllo

Il modo più semplice per confrontare queste piattaforme non è chiedersi quale sia “migliore”, ma che tipo di creator ciascuna serve.

Zorq AI è migliore quando il controllo del movimento fa parte di un processo di produzione che richiede stabilità. Se stai lavorando su video di prodotto, annunci UGC rifiniti, mascotte di brand o clip brevi approvate da clienti, un flusso che parte dall’immagine statica è più facile da gestire. Stai riducendo l’incertezza prima ancora di animare qualcosa.

VideoWeb AI è migliore quando il controllo del movimento fa parte di un processo di test creativo. Se vuoi provare percorsi di camera, confrontare modelli o sperimentare tipi di movimento diversi, la varietà di modelli diventa un vero vantaggio. Ti offre più spazio per esplorare, specialmente se il tuo lavoro è meno basato sulle approvazioni e più sull’iterazione.

Confronto affiancato

| Categoria | Zorq AI | VideoWeb AI |

|---|---|---|

| Approccio principale al movimento | Prima immagine statica, poi animazione | Pianificazione del movimento più rendering multi-modello |

| Miglior utilizzo | Lavori di brand, approvazioni, clip di prodotto | Creator, tester, workflow multi-modello |

| Stack di motion control | Controllo del movimento basato su Kling | Higgsfield più rendering basato su Kling |

| Punto di forza | Coerenza visiva e flusso di revisione | Flessibilità e scelta del modello |

| Curva di apprendimento | Più facile da comprendere | Migliore per utenti che vogliono più opzioni |

| Workflow ideale | Approva il frame, poi aggiungi il movimento | Progetta il movimento, poi confronta gli output |

Quale sembra più forte nella pratica?

Per annunci di prodotto e contenuti brevi rifiniti, Zorq AI ha l’argomentazione più lineare. Bloccare un fermo immagine prima dell’animazione ha senso quando ogni revisione costa tempo e genera confusione. Se l’angolazione del prodotto, l’illuminazione o il volto del personaggio devono rimanere coerenti, questo workflow è rassicurante.

Per clip cinematografiche, esplorazione di concept e creator a cui piace provare più famiglie di modelli, VideoWeb AI è più allettante. La combinazione di pianificazione del movimento e scelta del modello offre una superficie creativa più ampia. Non significa sempre risultati più rapidi, ma spesso più margine per rifinire l’esatto “feel” di una ripresa.

Per contenuti di danza, gesti marcati o performance, la risposta dipende dal tuo obiettivo. Se hai bisogno di output prevedibile e adatto al brand, Zorq AI può essere più facile da gestire. Se vuoi sperimentare stili di movimento e vedere come diversi motori di rendering interpretano la stessa idea di ripresa, VideoWeb AI ha il vantaggio.

Verdettto finale

Se vuoi la versione più breve, è questa: Zorq AI è più adatto ai creator che desiderano un workflow stabile da immagine statica a movimento, mentre VideoWeb AI è più adatto ai creator che vogliono una toolkit di controllo del movimento più ampia.

Zorq AI ha un feeling più editoriale. VideoWeb AI ha un feeling più esplorativo.

Questo non rende uno universalmente migliore dell’altro. Significa solo che risolvono frustrazioni diverse. Se il tuo problema principale è la coerenza visiva e l’attrito nelle approvazioni, Zorq AI è più facile da giustificare. Se il tuo problema principale è trovare il giusto linguaggio del movimento attraverso più strumenti e modelli, VideoWeb AI ti lascia più spazio di manovra.

In un mercato pieno di promesse generiche sui video AI, questa distinzione è davvero utile.

Strumenti consigliati su VideoWeb AI

- Higgsfield Motion Control per progettare movimenti di camera più puliti e un comportamento delle inquadrature più diretto.

- Kling 2.6 se vuoi un rendering consapevole del movimento per clip brevi e rifinite.

- Kling 3.0 se vuoi un workflow Kling più recente per un output più cinematografico.

- Veo 3.1 per generazione realistica di video long-form e creazione video con consapevolezza dell’audio.

- Vidu Q3 per creator che vogliono un altro modello video avanzato nello stesso spazio di lavoro.

- Runway Gen 4 per generazioni brevi, cinematiche e rifinite con forte coerenza visiva.

- Seedance 2.0 per utenti che confrontano i principali modelli video odierni in un unico posto.

Articolo correlato

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results