もし最近 AI 動画ツールをテストしたことがあるなら、同じ問題に気づいているはずです。モデルに「動画を生成させる」こと自体は簡単ですが、「自分が望む動き」をさせるのはずっと難しい。そのところで「モーションコントロール」が重要になってきます。

多くの人はまずAI 動画ジェネレーターを探しますが、実際のニーズはもっと具体的なことがほとんどです。クリエイターは、ふらつかずにスッと前に滑るようなプロダクトショットが欲しい。キャラクターがモデルから外れて漂ってしまうのではなく、自然に振り向いてほしい。ランダムではなく「演出された」と感じられるイメージから動画へのワークフローが欲しいのです。

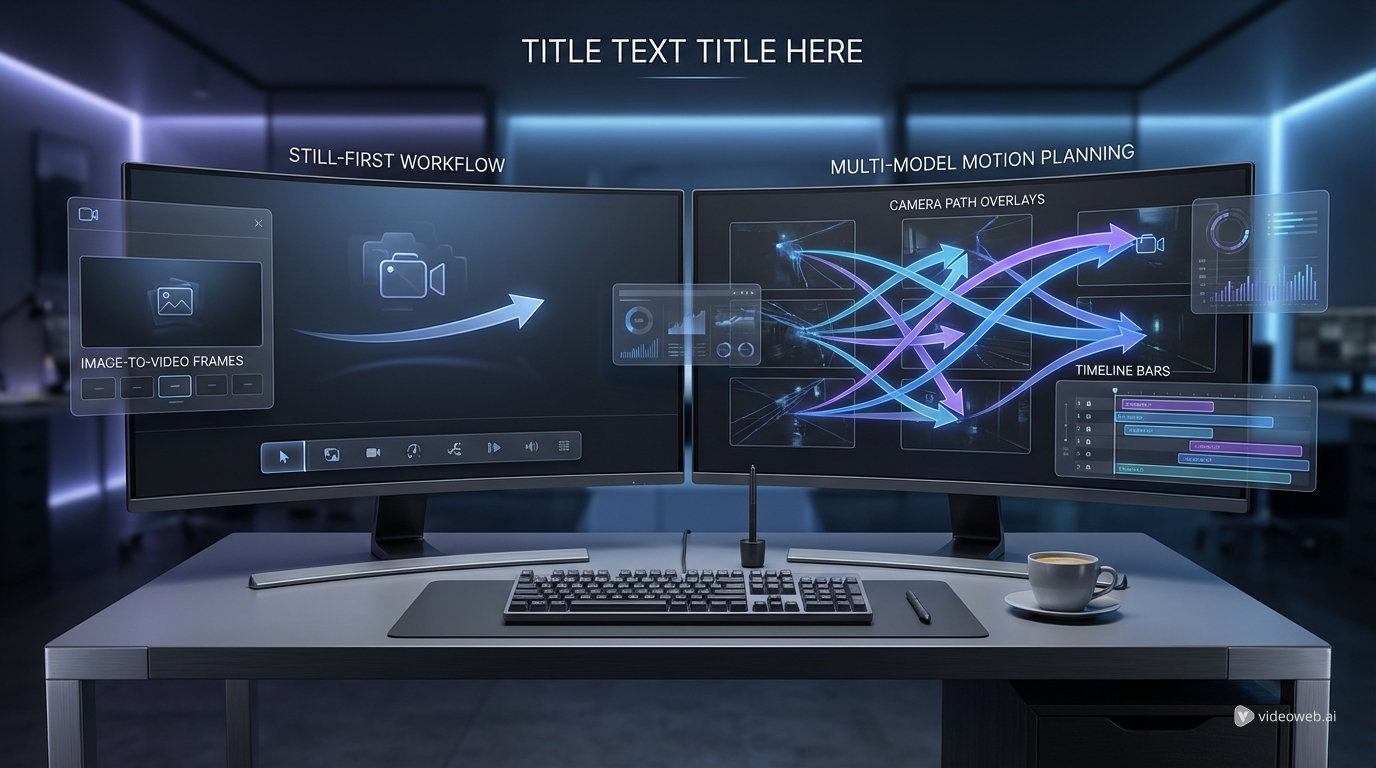

そこで、Zorq AI と VideoWeb AI を比較する意味が出てきます。どちらもモーション重視の AI 動画制作に役立ちますが、そのアプローチはかなり違います。Zorq AI は「静止画を起点とする」ワークフローに特化しているのに対して、VideoWeb AI は Higgsfield Motion Control、Kling 2.6、Kling 3.0 などのツールを軸にした、より広いマルチモデル型のシステムに寄せています。

モーションコントロールとは何か

平たく言えば、モーションコントロールとは「こう動いてほしい」とショットの動きをモデルに指示することであり、「プロンプト任せでなんとかなることを祈る」状態から脱することです。そこには、カメラワーク、被写体の動き、テンポ、前景と背景の関係性といった要素が含まれます。ショートフォームのコンテンツでは、この差が非常に大きくなります。

通常のプロンプトだけだと、何度も試してようやく使える結果が得られることが多いでしょう。モーションコントロール前提のワークフローは、最初から「動き」を意図的に設計することで、その試行回数を減らすことを狙っています。広告、SNS クリップ、マスコットアニメーション、シネマティックなテストなど、どんな用途でも重要なポイントです。

AI 動画用モーションコントロール、Kling AI、Higgsfield AI のようなキーワードへの関心が高まっているのも、そうした流れを反映しています。ユーザーは汎用的な動画生成を卒業し、「動き」をよりクリーンに制御したいと考え始めているのです。

Zorq AI:静止画を起点としたモーションワークフロー

Zorq AI は、「とにかく見た目の一貫性を最優先したい」場合に最も理にかなっています。公開されているワークフローでは、まず静止画を生成して承認し、その「まさにその見た目」を動画にしていくことが強調されています。一見シンプルですが、これは AI 動画の最も厄介な問題のひとつ──気に入った静止画と、そこから生成された動画との間の「ズレ(ドリフト)」──を解決します。

ブランドチームやクライアント、社内承認プロセスが絡むクリエイターにとって、このやり方はとても実務的です。まず構図を固定し、プロダクトやキャラクターの見た目が正しいか確認してから、初めてアニメーションさせる。これは、多くの動画プラットフォームが採用している「探索型」のスタイルとはかなり違うマインドセットです。

Zorq AI はまた、Kling ベースのモーションコントロール──Kling 2.6 Motion Control や Kling 3 Motion Control──を前面に押し出しています。価値があるのは、強力な動画モデルを使っているという点だけではなく、それらを「承認プロセスに適した形」で包み込んでいることです。ワークフローが承認・差し戻しに依存する場合、これは生のモデル性能と同じくらい重要になります。

VideoWeb AI:より広い「モーションコントロール遊び場」

VideoWeb AI は、「いろいろ試したいクリエイターの作業空間」に近い感触です。ロックされた静止画を中心に据えるのではなく、より広いモデルのエコシステムを提示します。モーションコントロールという観点では、最もわかりやすいセットアップは、動きの設計に Higgsfield Motion Control、最終ショットのレンダリングに Kling 2.6 または Kling 3.0 を使う構成です。

この組み合わせが有用なのは、「意図」と「出力」を分離できるからです。Higgsfield は動きを定義し、Kling は実際の動画生成を担当します。複数のビジュアルスタイルを試したり、モデルごとの挙動を比較したり、異なる動きのアイデアを何度も練り直したいクリエイターにとっては、大きな強みになります。

VideoWeb AI には、モーションコントロール以外にも Veo 3.1、Vidu Q3、Runway Gen 4、Seedance 2.0 といった多くのモデルが揃っています。特定のレンダリングスタイルにパイプラインを縛られたくないのであれば、長期的な作業スペースとしての価値が高くなります。

本当の違い:コントロールに対する思想

これらのプラットフォームを比較するいちばん簡単な方法は、「どちらが優れているか」を問うことではありません。「どんなタイプのクリエイター向けか」を問うことです。

Zorq AI が向いているのは、「モーションコントロールが、安定性を重視する制作プロセスの一部」である場合です。プロダクト動画、仕上がりのきれいな UGC 広告、ブランドマスコット、クライアント承認が必要なショートクリップなどでは、静止画から始めるワークフローの方が管理しやすくなります。動かす前の段階で不確実性を減らしておけるからです。

VideoWeb AI が向いているのは、「モーションコントロールが、クリエイティブなテストプロセスの一部」である場合です。カメラワークを試したり、モデル同士を比較したり、動きのバリエーションを実験したいときには、モデルの幅広さが大きな武器になります。承認というよりも、反復と試行錯誤がメインの現場であればなおさらです。

並べて比較

| カテゴリ | Zorq AI | VideoWeb AI |

|---|---|---|

| 主なモーション手法 | 先に静止画を確定し、その後にアニメーション | モーション設計+複数モデルによるレンダリング |

| 最適な用途 | ブランド案件、承認プロセス、プロダクト動画 | クリエイター、テスター、マルチモデルワークフロー |

| モーション制御スタック | Kling ベースのモーションコントロール | Higgsfield+Kling ベースのレンダリング |

| 強み | ビジュアルの一貫性とレビューのしやすさ | 柔軟性とモデル選択の自由度 |

| 学習コスト | 直感的で習得しやすい | 選択肢を活かしたいユーザー向き |

| 理想的なワークフロー | フレームを承認してから動きを付ける | 動きを設計してから出力を比較する |

実際に使ったとき、どちらが強く感じられるか

プロダクト広告や洗練されたショートフォームコンテンツでは、Zorq AI の方が筋の通った提案に聞こえます。アニメーション前に静止画をロックしておくのは、リビジョンのたびに時間と混乱が増える状況では理にかなっています。プロダクトの角度、光の当たり方、キャラクターの顔などを一貫させる必要があるなら、このワークフローは安心材料になります。

シネマティックなクリップ、コンセプトの探索、複数のモデルファミリーを試すのが好きなクリエイターには、VideoWeb AI の方が魅力的に映るでしょう。モーション設計とモデル選択の組み合わせは、より広いクリエイティブな余地を提供してくれます。必ずしも結果が早く出るとは限りませんが、「ショットの雰囲気」を追い込むための余白は確実に増えます。

ダンス、ジェスチャー主体、パフォーマンス系のコンテンツでは、目的次第で答えが変わります。予測しやすくブランドセーフな出力が必要なら、Zorq AI の方が管理しやすいかもしれません。動きのスタイルを試行錯誤し、同じショットのアイデアを異なるレンダリングエンジンがどう解釈するか見比べたいなら、VideoWeb AI に分があります。

最終的な結論

最も短くまとめるならこうです。Zorq AI は「安定した静止画から動画へのワークフロー」を求めるクリエイター向けであり、VideoWeb AI は「より広いモーションコントロールのツールキット」を求めるクリエイター向けです。

Zorq AI はより「編集志向」、VideoWeb AI はより「探索志向」のツールに感じられます。

どちらかが絶対的に優れているわけではなく、解決してくれるフラストレーションの種類が違うだけです。主な課題がビジュアルの一貫性と承認プロセスの摩擦であれば、Zorq AI の方が導入の説得材料になりやすいでしょう。主な課題が、複数のツールやモデルをまたいで「しっくりくる動きの言語」を見つけることなら、VideoWeb AI の方が試せる余地が広がります。

汎用的な AI 動画ツールの約束が溢れる市場において、この違いはむしろ有用だと言えます。

VideoWeb AI でおすすめのツール

- Higgsfield Motion Control

─ カメラワークをクリーンに設計し、より指向性のあるショット挙動を実現したいときに。 - Kling 2.6

─ モーション認識に優れたレンダリングで、仕上がりのきれいなショートクリップを作りたいときに。 - Kling 3.0

─ よりシネマティックな出力を狙える、新しい Kling ワークフローを使いたいときに。 - Veo 3.1

─ リアル寄りの長尺生成や、音声を意識した動画制作を行いたいときに。 - Vidu Q3

─ 同じ作業スペース内で、もうひとつ高度な動画モデルを試したいクリエイター向けに。 - Runway Gen 4

─ ビジュアルの一貫性に優れた、短く洗練されたシネマティック生成を行いたいときに。 - Seedance 2.0

─ 今日の主要な動画モデルを一箇所で比較したいユーザー向けに。

関連記事

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results