Se você passou algum tempo testando ferramentas de vídeo com IA recentemente, provavelmente percebeu o mesmo problema: fazer um modelo gerar um vídeo é fácil, mas fazer com que ele se mova do jeito que você quer é muito mais difícil. É aí que o controle de movimento começa a importar.

Muitas pessoas procuram por um gerador de vídeo com IA, mas a necessidade real geralmente é mais específica. Criadores querem um take de produto que deslize para frente em vez de tremer. Querem que um personagem gire de forma natural em vez de sair do modelo. Querem um fluxo de trabalho de imagem para vídeo que pareça dirigido, não aleatório.

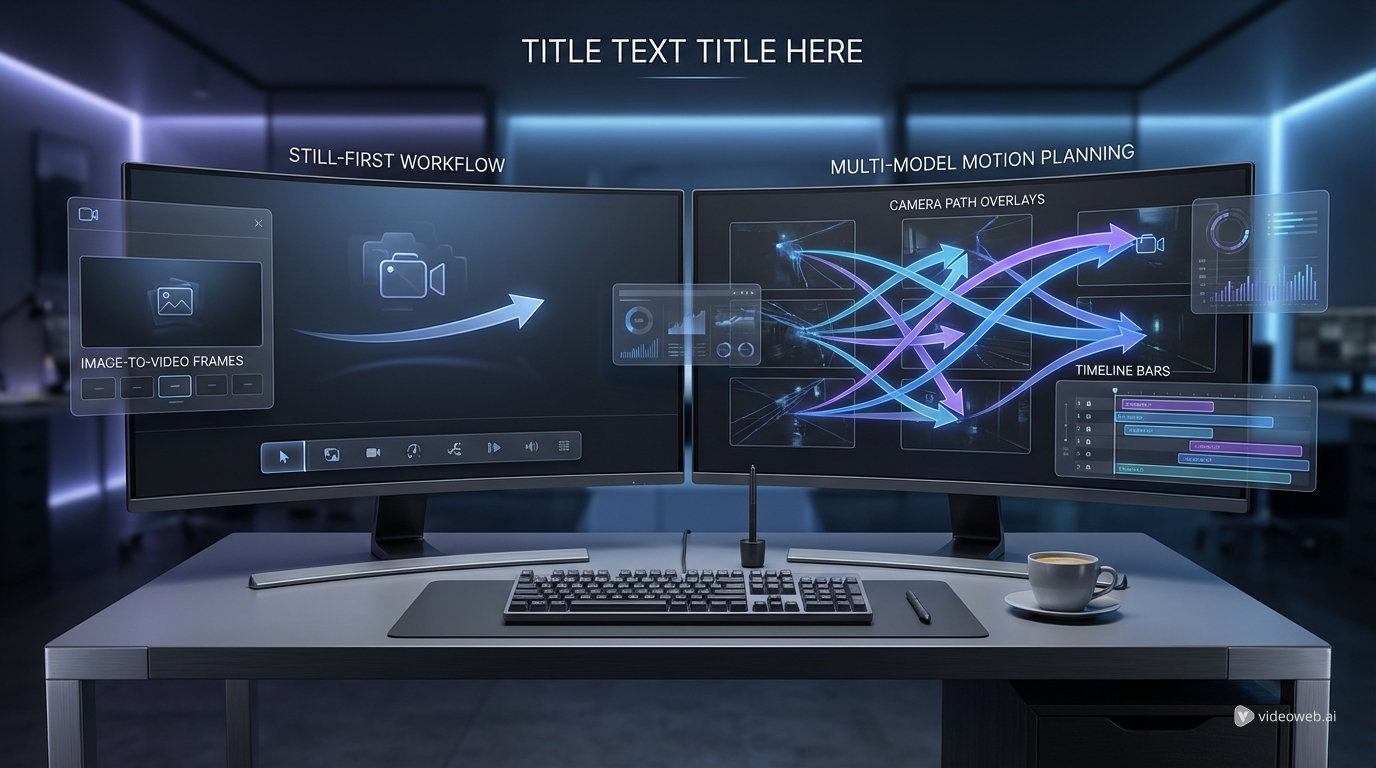

É por isso que comparar o Zorq AI e o VideoWeb AI é interessante. Ambos podem ajudar com vídeos de IA guiados por movimento, mas abordam o problema por ângulos diferentes. O Zorq AI é construído em torno de um fluxo de trabalho “imagem estática primeiro”, enquanto o VideoWeb AI aposta em um sistema multimodelos mais amplo, estruturado em ferramentas como o Higgsfield Motion Control, Kling 2.6, e Kling 3.0.

O que controle de movimento realmente significa

Em termos simples, controle de movimento significa dizer ao modelo como o take deve se mover em vez de apenas torcer para que o prompt chegue lá. Isso pode incluir direção de câmera, movimento do sujeito, ritmo e a relação entre primeiro plano e fundo. Em conteúdo de curta duração, essa diferença é enorme.

Um prompt normal pode gerar um resultado utilizável depois de várias tentativas. Um fluxo de trabalho com controle de movimento é feito para reduzir essas tentativas ao tornar o movimento mais intencional desde o início. Isso importa esteja você criando anúncios, clipes para redes sociais, animação de mascotes ou testes cinematográficos.

O interesse por termos como controle de movimento para vídeo com IA, Kling AI, e Higgsfield AI também reflete essa mudança. Os usuários estão indo além da geração genérica de vídeo e buscando um controle mais limpo.

Zorq AI: um fluxo de movimento centrado em imagens estáticas

O Zorq AI faz mais sentido se a sua primeira prioridade é consistência. Seu fluxo de trabalho público enfatiza gerar ou aprovar uma imagem estática primeiro, e depois transformar exatamente aquele visual em movimento. Isso parece simples, mas resolve um dos problemas mais irritantes em vídeo com IA: o desvio entre a imagem de que você gostou e o vídeo que você recebeu.

Para criadores que trabalham com equipes de marca, clientes ou aprovações internas, essa abordagem é prática. Você pode travar a composição primeiro, garantir que o produto ou personagem esteja certo e só então animar. É uma mentalidade bem diferente do estilo mais exploratório de muitas plataformas de vídeo.

O Zorq AI também destaca publicamente o controle de movimento baseado em Kling, incluindo Kling 2.6 Motion Control e Kling 3 Motion Control. O valor aqui não é apenas usar modelos de vídeo fortes, mas envolvê-los em um processo mais amigável a aprovações. Se o seu fluxo de trabalho depende de “sign-off”, isso importa tanto quanto a qualidade bruta do modelo.

VideoWeb AI: um playground mais amplo de controle de movimento

O VideoWeb AI parece mais um espaço de trabalho para criadores que querem opções. Em vez de centralizar tudo em uma imagem estática travada, ele apresenta um ecossistema de modelos mais amplo. Para controle de movimento especificamente, sua configuração mais clara é usar o Higgsfield Motion Control para planejar o movimento e depois o Kling 2.6 ou Kling 3.0 para renderizar o take final.

Essa combinação é útil porque separa intenção de resultado. O Higgsfield ajuda a definir o movimento, enquanto o Kling cuida da geração de vídeo em si. Para criadores que querem testar múltiplos estilos visuais, comparar o comportamento de modelos ou iterar em diferentes ideias de movimento, isso é uma vantagem forte.

O VideoWeb AI também tem um leque maior de modelos além do controle de movimento, incluindo Veo 3.1, Vidu Q3, Runway Gen 4, e Seedance 2.0. Isso lhe dá mais valor como espaço de trabalho de longo prazo se você não quiser que o seu pipeline fique preso a um único estilo de renderização.

A verdadeira diferença: filosofia de controle

A forma mais simples de comparar essas plataformas não é perguntando qual é “melhor”. É perguntando que tipo de criador cada uma atende.

O Zorq AI é melhor quando o controle de movimento faz parte de um processo de produção que precisa de estabilidade. Se você trabalha em vídeos de produto, anúncios de UGC polidos, mascotes de marca ou clipes curtos aprovados por clientes, um fluxo “imagem estática primeiro” é mais fácil de gerenciar. Você reduz incertezas antes mesmo de animar qualquer coisa.

O VideoWeb AI é melhor quando o controle de movimento faz parte de um processo de testes criativos. Se você quer experimentar trajetórias de câmera, comparar modelos ou testar diferentes tipos de movimento, sua variedade de modelos se torna uma vantagem real. Ele oferece mais espaço para explorar, especialmente se o seu trabalho tiver menos peso de aprovação e mais foco em iteração.

Comparação lado a lado

| Categoria | Zorq AI | VideoWeb AI |

|---|---|---|

| Abordagem principal de movimento | Imagem estática primeiro, depois animação | Planejamento de movimento + renderização multimodelos |

| Melhor encaixe | Trabalho de marca, aprovações, clipes de produto | Criadores, testadores, fluxos multimodelos |

| Stack de controle de movimento | Controle de movimento baseado em Kling | Higgsfield + renderização baseada em Kling |

| Força | Consistência visual e fluxo de revisão | Flexibilidade e escolha de modelos |

| Curva de aprendizado | Mais fácil de entender | Melhor para usuários que querem mais opções |

| Fluxo ideal | Aprovar o quadro, depois adicionar movimento | Planejar o movimento, depois comparar resultados |

Qual parece mais forte na prática?

Para anúncios de produto e conteúdo de curta duração polido, o Zorq AI tem o discurso mais enxuto. Travar uma imagem estática antes da animação faz sentido quando cada revisão custa tempo e confusão. Se o ângulo do produto, a iluminação ou o rosto do personagem precisam permanecer consistentes, esse fluxo de trabalho é tranquilizador.

Para clipes cinematográficos, exploração de conceito e criadores que gostam de testar múltiplas famílias de modelos, o VideoWeb AI é mais atraente. A combinação de planejamento de movimento e escolha de modelos oferece uma superfície criativa maior. Isso nem sempre significa resultados mais rápidos, mas frequentemente significa mais espaço para refinar o clima exato de um take.

Para conteúdo de dança, gestos marcados ou performances, a resposta depende do seu objetivo. Se você precisa de um resultado previsível e seguro para a marca, o Zorq AI pode ser mais fácil de administrar. Se você quer experimentar estilos de movimento e ver como diferentes motores de renderização interpretam a mesma ideia de take, o VideoWeb AI leva vantagem.

Veredito final

Se você quiser a versão mais curta, é esta: o Zorq AI é a melhor opção para criadores que querem um fluxo de trabalho estável de imagem estática para movimento, enquanto o VideoWeb AI é a melhor opção para criadores que querem um kit de ferramentas mais amplo de controle de movimento.

O Zorq AI parece mais editorial. O VideoWeb AI parece mais exploratório.

Isso não torna um universalmente melhor que o outro. Significa apenas que eles resolvem frustrações diferentes. Se o seu principal problema é consistência visual e atrito nas aprovações, o Zorq AI é mais fácil de justificar. Se o seu principal problema é encontrar a linguagem de movimento certa em múltiplas ferramentas e modelos, o VideoWeb AI oferece mais espaço para trabalhar.

Em um mercado cheio de promessas genéricas de vídeo com IA, essa distinção é realmente útil.

Ferramentas recomendadas no VideoWeb AI

- Higgsfield Motion Control para desenhar movimentos de câmera mais limpos e comportamento de take mais dirigido.

- Kling 2.6 se você quer renderização com consciência de movimento para clipes curtos polidos.

- Kling 3.0 se você quer um fluxo Kling mais novo para resultados mais cinematográficos.

- Veo 3.1 para geração realista de longa duração e criação de vídeo com consciência de áudio.

- Vidu Q3 para criadores que querem outro modelo avançado de vídeo no mesmo espaço de trabalho.

- Runway Gen 4 para gerações curtas e cinematográficas polidas, com forte consistência visual.

- Seedance 2.0 para usuários que estão comparando os principais modelos de vídeo atuais em um só lugar.

Artigo relacionado

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results