If vous avez passé du temps récemment à tester des outils vidéo d’IA, vous avez probablement remarqué le même problème : faire générer une vidéo par un modèle est facile, mais lui faire bouger les choses exactement comme vous le souhaitez est beaucoup plus difficile. C’est là que le contrôle du mouvement commence à devenir important.

Beaucoup de gens recherchent un générateur de vidéo IA, mais le besoin réel est souvent plus précis. Les créateurs veulent un plan produit qui glisse vers l’avant plutôt que de trembler. Ils veulent qu’un personnage se tourne naturellement au lieu de dériver hors modèle. Ils veulent un workflow image-vers-vidéo qui donne l’impression d’être dirigé, pas aléatoire.

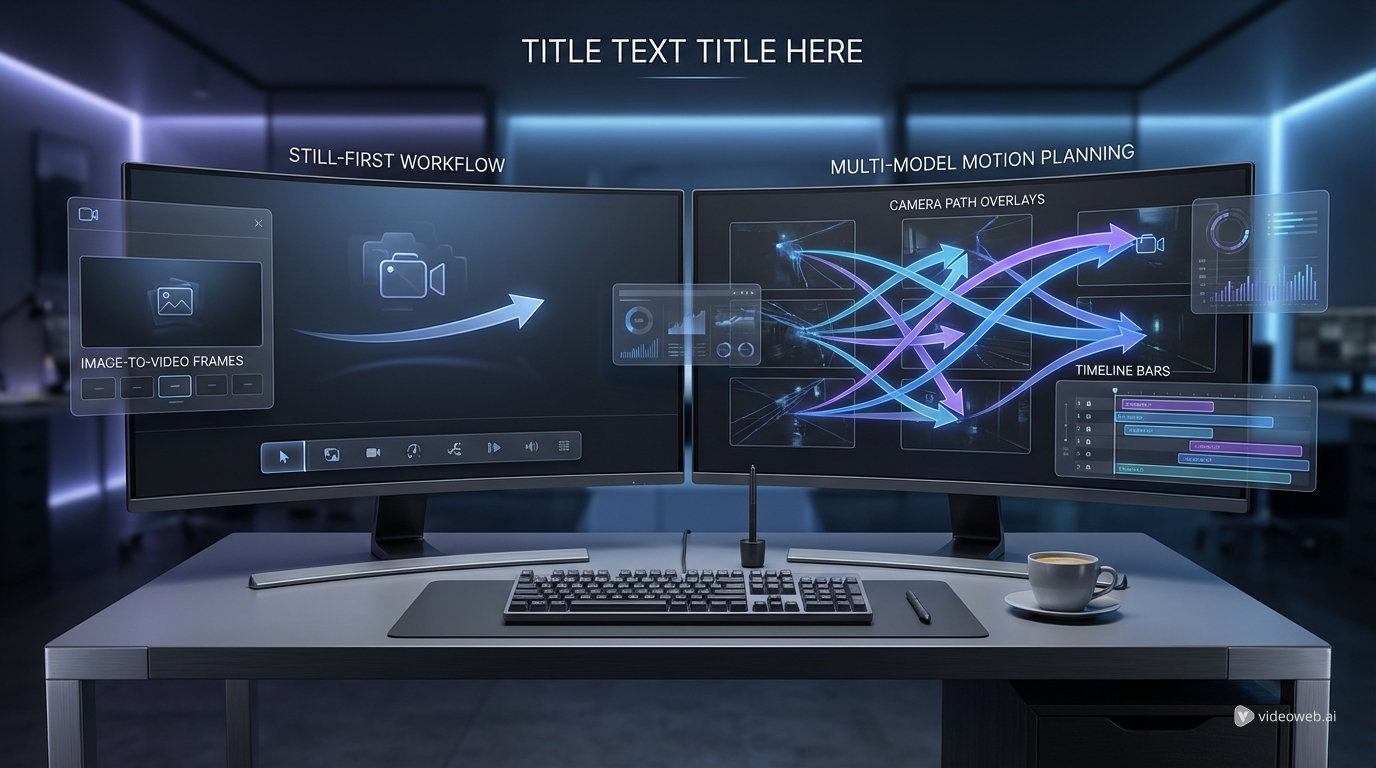

C’est pourquoi comparer Zorq AI et VideoWeb AI est intéressant. Les deux peuvent aider pour la vidéo IA pilotée par le mouvement, mais ils abordent le problème sous des angles différents. Zorq AI est construit autour d’un flux de travail centré sur l’image fixe, tandis que VideoWeb AI s’appuie sur un système plus large de modèles multiples, articulé autour d’outils comme Higgsfield Motion Control, Kling 2.6, et Kling 3.0.

Ce que le contrôle du mouvement signifie vraiment

En termes simples, le contrôle du mouvement signifie dire au modèle comment le plan doit se déplacer, au lieu d’espérer que le prompt y arrive tout seul. Cela peut inclure la direction de la caméra, le mouvement du sujet, le rythme et la relation entre premier plan et arrière-plan. Pour le contenu court, cette différence est énorme.

Un prompt normal pourrait vous donner un résultat exploitable après plusieurs essais. Un workflow de contrôle du mouvement est conçu pour réduire ces essais en rendant le mouvement plus intentionnel dès le départ. Cela compte que vous créiez des publicités, des clips sociaux, des animations de mascottes ou des tests cinématiques.

L’intérêt pour des termes comme contrôle du mouvement pour la vidéo IA, Kling IA, et Higgsfield IA reflète aussi ce changement. Les utilisateurs vont au-delà de la simple génération générique de vidéos et recherchent un contrôle plus propre.

Zorq AI : un flux de travail de mouvement centré sur l’image fixe

Zorq AI a le plus de sens si votre priorité numéro un est la cohérence. Son workflow public met l’accent sur la génération ou l’approbation d’une image fixe en premier, puis la transformation de ce visuel exact en mouvement. Cela paraît simple, mais ça résout l’un des problèmes les plus agaçants de la vidéo IA : la dérive entre l’image que vous aimiez et la vidéo que vous obtenez.

Pour les créateurs qui travaillent avec des équipes de marque, des clients ou des validations internes, cette approche est pratique. Vous pouvez verrouiller la composition d’abord, vous assurer que le produit ou le personnage est correct, puis seulement ensuite l’animer. C’est un état d’esprit très différent du style plus exploratoire de nombreuses plateformes vidéo.

Zorq AI met aussi en avant publiquement un contrôle du mouvement basé sur Kling, incluant Kling 2.6 Motion Control et Kling 3 Motion Control. La valeur ici n’est pas seulement d’utiliser de bons modèles vidéo, mais de les envelopper dans un processus plus adapté à l’approbation. Si votre flux de travail dépend de validations, cela compte autant que la qualité brute du modèle.

VideoWeb AI : un terrain de jeu plus large pour le contrôle du mouvement

VideoWeb AI ressemble davantage à un espace de travail pour créateurs qui veulent des options. Au lieu de tout centrer sur une image fixe verrouillée, la plateforme présente un écosystème plus large de modèles. Pour le contrôle du mouvement en particulier, sa configuration la plus claire consiste à utiliser Higgsfield Motion Control pour planifier le mouvement, puis Kling 2.6 ou Kling 3.0 pour le rendu du plan final.

Cette combinaison est utile parce qu’elle sépare l’intention du rendu. Higgsfield aide à définir le mouvement, tandis que Kling gère la génération vidéo elle-même. Pour les créateurs qui veulent tester plusieurs styles visuels, comparer le comportement des modèles ou itérer sur différentes idées de mouvement, c’est un avantage important.

VideoWeb AI dispose également d’un éventail de modèles plus large au-delà du contrôle du mouvement, incluant Veo 3.1, Vidu Q3, Runway Gen 4, et Seedance 2.0. Cela lui donne plus de valeur comme espace de travail à long terme si vous ne voulez pas que votre pipeline soit lié à un seul style de rendu.

La vraie différence : une philosophie du contrôle

La façon la plus simple de comparer ces plateformes n’est pas de demander laquelle est « meilleure », mais de se demander à quel type de créateur chacune s’adresse.

Zorq AI est préférable lorsque le contrôle du mouvement fait partie d’un processus de production qui a besoin de stabilité. Si vous travaillez sur des vidéos produit, des publicités UGC soignées, des mascottes de marque ou des clips courts validés par des clients, un flux centré sur l’image fixe est plus facile à gérer. Vous réduisez l’incertitude avant même d’animer quoi que ce soit.

VideoWeb AI est préférable lorsque le contrôle du mouvement fait partie d’un processus de test créatif. Si vous voulez essayer des trajectoires de caméra, comparer des modèles ou expérimenter différents types de mouvements, sa variété de modèles devient un véritable avantage. Elle vous donne plus de marge pour explorer, surtout si votre travail est moins soumis à l’approbation et davantage basé sur l’itération.

Comparaison côte à côte

| Catégorie | Zorq AI | VideoWeb AI |

|---|---|---|

| Approche principale du mouvement | Image fixe d’abord, puis animation | Planification du mouvement + rendu multi-modèle |

| Meilleur usage | Travail de marque, validations, clips produit | Créateurs, testeurs, workflows multi-modèles |

| Pile de contrôle du mouvement | Contrôle du mouvement basé sur Kling | Higgsfield + rendu basé sur Kling |

| Point fort | Cohérence visuelle et flux de validation | Flexibilité et choix de modèles |

| Courbe d’apprentissage | Plus facile à comprendre | Mieux pour les utilisateurs qui veulent plus d’options |

| Workflow idéal | Approuver l’image, puis ajouter le mouvement | Concevoir le mouvement, puis comparer les rendus |

Lequel paraît plus solide en pratique ?

Pour les publicités produit et le contenu court soigné, Zorq AI a un argumentaire plus clean. Verrouiller une image fixe avant l’animation a du sens quand chaque révision coûte du temps et génère de la confusion. Si l’angle du produit, la lumière ou le visage du personnage doit rester cohérent, ce workflow est rassurant.

Pour les clips cinématiques, l’exploration de concepts et les créateurs qui aiment essayer plusieurs familles de modèles, VideoWeb AI est plus attirant. La combinaison de la planification du mouvement et du choix de modèle vous donne plus de surface créative. Cela ne signifie pas toujours des résultats plus rapides, mais souvent davantage de marge pour affiner précisément le ressenti d’un plan.

Pour la danse, les contenus riches en gestes ou les performances, la réponse dépend de votre objectif. Si vous avez besoin d’un rendu prévisible et conforme à la marque, Zorq AI sera peut-être plus simple à gérer. Si vous voulez expérimenter des styles de mouvement et voir comment différents moteurs de rendu interprètent la même idée de plan, VideoWeb AI a l’avantage.

Verdict final

En version ultra courte : Zorq AI est mieux adapté aux créateurs qui veulent un flux de travail stable image-fixe-vers-mouvement, tandis que VideoWeb AI convient mieux à ceux qui recherchent une boîte à outils de contrôle du mouvement plus large.

Zorq AI paraît plus éditorial. VideoWeb AI paraît plus exploratoire.

Cela ne rend pas l’un universellement meilleur que l’autre. Cela signifie simplement qu’ils répondent à des frustrations différentes. Si votre principal problème est la cohérence visuelle et la friction liée aux validations, Zorq AI est plus facile à justifier. Si votre principal problème est de trouver le bon langage de mouvement à travers plusieurs outils et modèles, VideoWeb AI vous donne plus de marge de manœuvre.

Dans un marché saturé de promesses générales autour de la vidéo IA, cette distinction est réellement utile.

Outils recommandés sur VideoWeb AI

- Higgsfield Motion Control pour concevoir des mouvements de caméra plus fluides et un comportement de plan plus dirigé.

- Kling 2.6 si vous voulez un rendu sensible au mouvement pour des clips courts et soignés.

- Kling 3.0 si vous voulez un workflow Kling plus récent pour un rendu plus cinématique.

- Veo 3.1 pour une génération réaliste de formats longs et la création de vidéos sensibles à l’audio.

- Vidu Q3 pour les créateurs qui veulent un autre modèle vidéo avancé dans le même espace de travail.

- Runway Gen 4 pour des générations cinématiques courtes et soignées avec une forte cohérence visuelle.

- Seedance 2.0 pour les utilisateurs qui comparent les principaux modèles vidéo du moment au même endroit.

Article lié

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results