Wenn du in letzter Zeit Zeit mit dem Testen von KI-Videotools verbracht hast, ist dir wahrscheinlich dasselbe Problem aufgefallen: Ein Modell dazu zu bringen, überhaupt ein Video zu generieren, ist leicht – aber es so zu bewegen, wie du es willst, ist deutlich schwieriger. Genau hier wird Motion Control wichtig.

Viele Menschen suchen nach einem AI video generator, aber der eigentliche Bedarf ist meist viel spezifischer. Kreative wollen einen Produktshot, der sauber nach vorne gleitet statt zu wackeln. Sie wollen, dass sich eine Figur natürlich dreht statt off-model wegzudriften. Sie wollen einen image-to-video workflow, der sich gelenkt anfühlt – nicht zufällig.

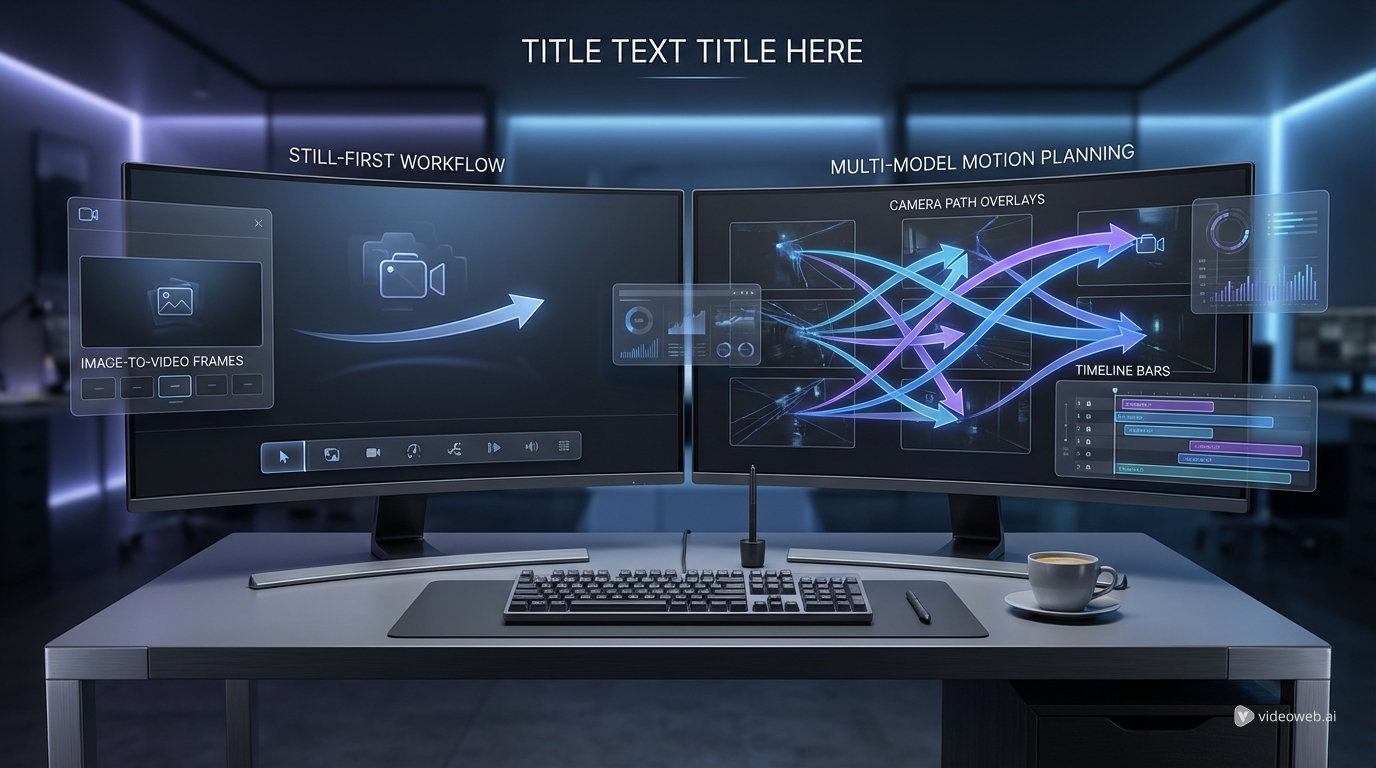

Deshalb ist der Vergleich von Zorq AI und VideoWeb AI interessant. Beide können bei bewegungsgetriebenem KI-Video helfen, gehen das Problem aber aus unterschiedlichen Richtungen an. Zorq AI ist rund um einen Still-first-Workflow aufgebaut, während VideoWeb AI auf ein breiteres Multi-Model-System setzt, das auf Tools wie Higgsfield Motion Control, Kling 2.6 und Kling 3.0 aufbaut.

Was Motion Control eigentlich bedeutet

Ganz einfach gesagt bedeutet Motion Control, dem Modell vorzugeben, wie sich der Shot bewegen soll – statt bloß zu hoffen, dass das Prompt schon irgendwie passt. Dazu gehören Kameraführung, Bewegung des Subjekts, Geschwindigkeit und das Verhältnis von Vorder- zu Hintergrund. Gerade bei Short-Form-Content ist dieser Unterschied enorm.

Ein normales Prompt liefert dir vielleicht nach mehreren Versuchen ein brauchbares Ergebnis. Ein Motion-Control-Workflow soll diese Versuche reduzieren, indem Bewegung von Anfang an bewusster geplant wird. Das ist wichtig – egal ob du Ads, Social-Clips, Maskottchen-Animationen oder filmische Tests erstellst.

Das wachsende Interesse an Begriffen wie motion control for AI video, Kling AI, und Higgsfield AI spiegelt genau diese Entwicklung wider. Nutzer gehen über generische Videogenerierung hinaus und suchen nach sauberer Steuerung.

Zorq AI: ein Still-first Motion-Workflow

Zorq AI ergibt vor allem dann Sinn, wenn dein oberstes Ziel Konsistenz ist. Der öffentliche Workflow setzt klar darauf, zunächst ein Standbild zu generieren oder freizugeben und genau dieses Bild danach in Bewegung zu versetzen. Das klingt banal, löst aber eines der nervigsten Probleme bei KI-Video: die Abweichung zwischen dem Bild, das dir gefallen hat, und dem Video, das du am Ende bekommst.

Für Kreative, die mit Brand-Teams, Kunden oder internen Freigaben arbeiten, ist dieser Ansatz praxisnah. Du fixierst zuerst die Komposition, stellst sicher, dass Produkt oder Charakter richtig aussehen, und animierst erst dann. Das ist eine völlig andere Denkweise als der eher explorative Stil vieler Video-Plattformen.

Zorq AI hebt öffentlich auch Kling-basiertes Motion Control hervor, darunter Kling 2.6 Motion Control und Kling 3 Motion Control. Der Mehrwert liegt nicht nur darin, starke Videomodelle zu nutzen, sondern sie in einen freigabeorientierten Prozess einzubetten. Wenn dein Workflow von Abnahmen abhängt, ist das mindestens so wichtig wie die reine Modellqualität.

VideoWeb AI: ein breiterer Motion-Control-Spielplatz

VideoWeb AI fühlt sich eher wie ein Creator-Workspace für Menschen an, die Optionen wollen. Statt alles um ein fixiertes Standbild zu zentrieren, präsentiert es ein breiteres Modell-Ökosystem. Für Motion Control ist das klarste Setup: Higgsfield Motion Control zur Bewegungsplanung und anschließend Kling 2.6 oder Kling 3.0 für das Rendering des finalen Shots.

Diese Kombination ist hilfreich, weil sie Intention und Output trennt. Higgsfield hilft, die Bewegung zu definieren, während Kling die eigentliche Videogenerierung übernimmt. Für Kreative, die mehrere visuelle Stile testen, Modellverhalten vergleichen oder verschiedene Bewegungs-Ideen durchspielen wollen, ist das ein klarer Vorteil.

VideoWeb AI bietet zudem eine breitere Modellpalette über Motion Control hinaus, darunter Veo 3.1, Vidu Q3, Runway Gen 4, und Seedance 2.0. Dadurch eignet es sich stärker als langfristiger Workspace, wenn du deinen Pipeline nicht an einen einzigen Renderstil binden willst.

Der eigentliche Unterschied: Kontroll-Philosophie

Am einfachsten lassen sich diese Plattformen vergleichen, wenn man nicht fragt, welche „besser“ ist, sondern welche Art von Kreativen sie jeweils bedienen.

Zorq AI ist die bessere Wahl, wenn Motion Control Teil eines Produktionsprozesses ist, der Stabilität braucht. Wenn du an Produktvideos, polierten UGC-Ads, Markenmaskottchen oder vom Kunden freigegebenen Short-Clips arbeitest, ist ein Still-first-Flow leichter zu steuern. Du reduzierst Unsicherheit, bevor du überhaupt etwas animierst.

VideoWeb AI ist die bessere Wahl, wenn Motion Control Teil eines kreativen Testprozesses ist. Wenn du Kamerapfade ausprobieren, Modelle vergleichen oder mit verschiedenen Bewegungsarten experimentieren willst, wird die Modellvielfalt zum echten Pluspunkt. Du erhältst mehr Raum zum Explorieren – besonders, wenn deine Arbeit weniger freigabegetrieben und stärker iterativ ist.

Direktvergleich

| Kategorie | Zorq AI | VideoWeb AI |

|---|---|---|

| Haupt-Ansatz Motion | Erst Still, dann animieren | Bewegungsplanung plus Multi-Model-Rendering |

| Bestes Einsatzfeld | Brand-Arbeit, Freigaben, Produktclips | Creator, Tester, Multi-Model-Workflows |

| Motion-Control-Stack | Kling-basiertes Motion Control | Higgsfield plus Kling-basiertes Rendering |

| Stärke | Visuelle Konsistenz und Review-Flow | Flexibilität und Modellauswahl |

| Lernkurve | Leichter zu verstehen | Besser für Nutzer mit Wunsch nach Optionen |

| Ideal-Workflow | Frame freigeben, dann Bewegung hinzufügen | Bewegung designen, dann Outputs vergleichen |

Welche Lösung wirkt in der Praxis stärker?

Für Produkt-Ads und polierten Short-Form-Content hat Zorq AI das klarere Versprechen. Ein Still vor der Animation zu fixieren, ist sinnvoll, wenn jede Revision Zeit und Verwirrung kostet. Wenn Produktwinkel, Lichtsetzung oder Charaktergesicht konsistent bleiben müssen, wirkt dieser Workflow beruhigend.

Für filmische Clips, Konzept-Exploration und Kreative, die gern mit unterschiedlichen Modellfamilien experimentieren, ist VideoWeb AI anziehender. Die Kombination aus Bewegungsplanung und Modellauswahl gibt dir mehr kreative Fläche. Das bedeutet nicht immer schnellere Ergebnisse, aber oft mehr Spielraum, um den exakten „Feel“ eines Shots zu verfeinern.

Bei Dance-, gestenlastigem oder performanceorientiertem Content hängt die Antwort von deinem Ziel ab. Wenn du planbares, markensicheres Output brauchst, lässt sich Zorq AI leichter kontrollieren. Wenn du mit Bewegungsstilen experimentieren und sehen willst, wie verschiedene Render-Engines dieselbe Shot-Idee interpretieren, hat VideoWeb AI die Nase vorn.

Fazit

In der kürzesten Fassung lautet es so: Zorq AI passt besser zu Kreativen, die einen stabilen Still-to-Motion-Workflow wollen, während VideoWeb AI besser für Kreative geeignet ist, die ein breiteres Motion-Control-Toolkit brauchen.

Zorq AI wirkt redaktioneller. VideoWeb AI wirkt explorativer.

Das macht keines von beiden universell „besser“. Sie lösen unterschiedliche Frustrationen. Wenn dein Hauptproblem visuelle Konsistenz und Freigabe-Reibung ist, lässt sich Zorq AI leichter rechtfertigen. Wenn dein Hauptproblem darin besteht, über mehrere Tools und Modelle hinweg die richtige „Motion Language“ zu finden, bietet dir VideoWeb AI mehr Spielraum.

In einem Markt voller generischer KI-Video-Versprechen ist genau dieser Unterschied tatsächlich nützlich.

Empfohlene Tools auf VideoWeb AI

- Higgsfield Motion Control für präzisere Kamerabewegungen und gezielteres Shot-Verhalten.

- Kling 2.6 wenn du bewegungsbewusstes Rendering für polierte Short-Clips möchtest.

- Kling 3.0 wenn du einen neueren Kling-Workflow für filmischere Ergebnisse willst.

- Veo 3.1 für realistische Long-Form-Generierung und Audio-aware Videoerstellung.

- Vidu Q3 für Kreative, die ein weiteres fortgeschrittenes Videomodell im selben Workspace wollen.

- Runway Gen 4 für kurze, polierte, filmische Generierungen mit starker visueller Konsistenz.

- Seedance 2.0 für Nutzer, die die aktuell führenden Videomodelle an einem Ort vergleichen wollen.

Verwandte Artikel

- Motion-Control Videos Made Simple: Higgsfield + Kling 2.6 on VideoWeb AI

- Higgsfield AI Motion Control with Kling 3.0: How It Works and What It Does Well

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use?

- Which Vidu Model Is Best? Q1 vs Q2 vs Q3 Explained

- Kling 3.0 on VideoWeb AI: What’s New and How to Get Cinematic Results