Si vous suivez de près la vidéo IA, un nom est apparu presque de nulle part et a instantanément commencé à monopoliser la conversation : Happy Horse AI. Ce qui rend l’histoire intéressante, ce n’est pas seulement l’attention soudaine. C’est la manière dont ce modèle s’est imposé dans le paysage : peu de contexte, très peu d’explications publiques, et pourtant de solides performances dans les classements comparatifs à l’aveugle que les créateurs suivent réellement.

C’est pourquoi il s’agit aujourd’hui de l’un des développements les plus commentés dans la vidéo IA. Un nouveau venu mystérieux est apparu, les gens le testent, et beaucoup se posent la même question : s’agit-il simplement d’une vague de hype éphémère, ou est-ce le signe réel que le classement des meilleurs modèles vidéo est en train de changer ?

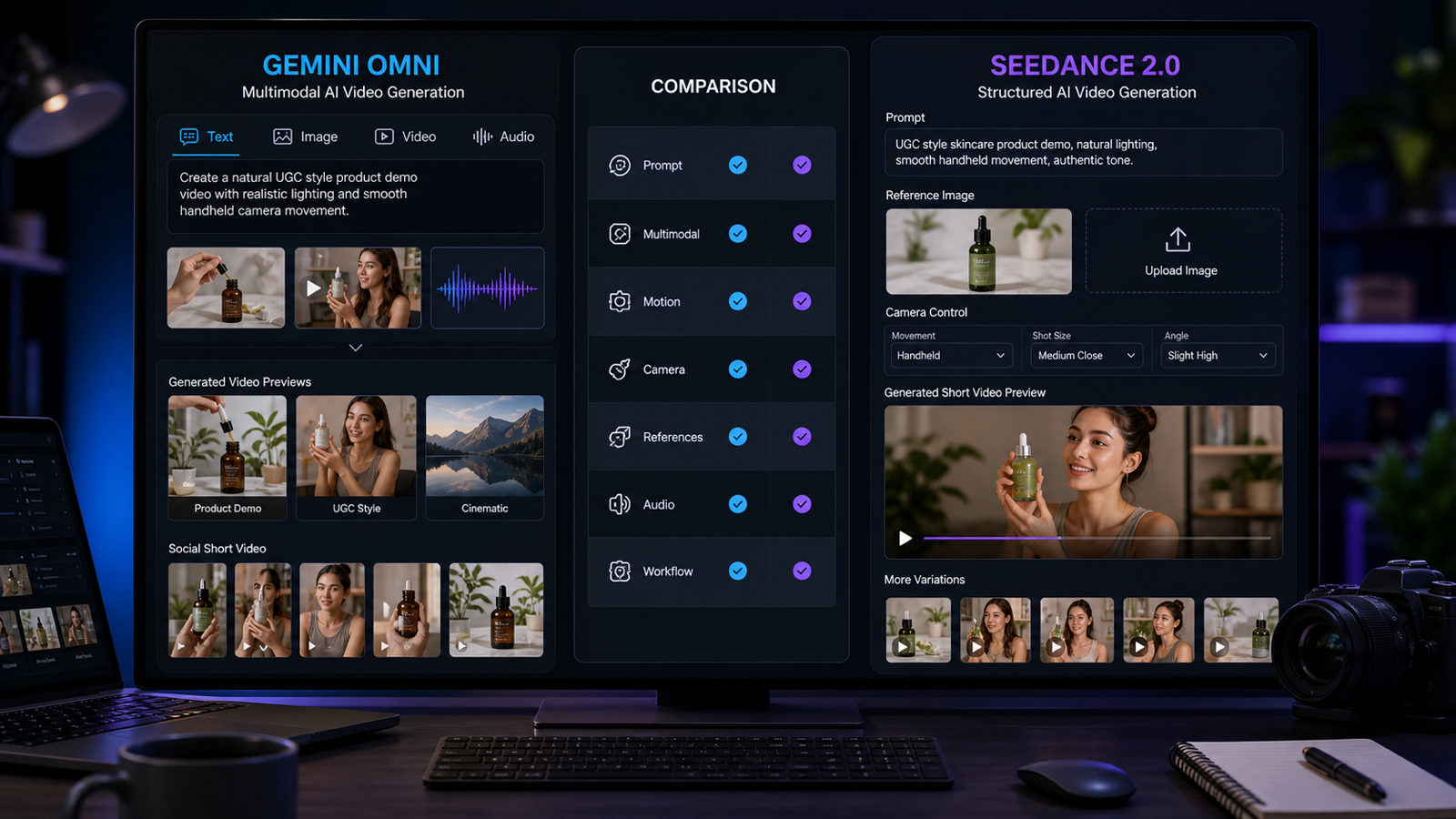

En même temps, c’est aussi le bon moment pour le comparer à un rival plus établi. Seedance 2.0 video dispose d’un récit produit public beaucoup plus clair, d’une documentation plus solide, et d’une réputation plus mûre auprès des utilisateurs qui veulent des rendus contrôlables, prêts pour la production. Donc, même si le buzz se concentre actuellement sur Happy Horse, la vraie conversation est plus vaste. Elle porte sur le mystère versus la clarté, l’élan surprise versus la capacité structurée, et la curiosité versus la fiabilité.

Pour les créateurs, les marketeurs, et tous ceux qui recherchent un générateur de vidéo IA fiable, cette comparaison est importante, car les titres de classement ne racontent pas toute l’histoire. Un modèle peut attirer l’attention très vite, mais ce qui compte vraiment, c’est la façon dont il s’intègre dans des workflows réels.

Pourquoi Happy Horse 1.0 est devenu si vite digne des gros titres

La principale raison pour laquelle Happy Horse 1.0 fait parler de lui est simple : il est monté au sommet des classements actuels de vidéos à vote à l’aveugle si rapidement que les gens ont dû s’arrêter et se demander de quoi il s’agissait. Dans un paysage saturé où de nouvelles versions apparaissent en permanence, très peu de modèles arrivent avec un impact aussi immédiat.

Cet effet de surprise fait une grande partie du travail. Lorsqu’un modèle vient d’une entreprise majeure et bien connue, on s’attend déjà à de la finition, à de solides démos et à un lancement marketing. Mais Happy Horse 1.0 donne une impression différente. Son identité publique reste relativement floue par rapport à d’autres grands outils de vidéo IA, et ce mystère fait partie des raisons pour lesquelles les créateurs lui prêtent une attention si soutenue.

L’argument de vente public du modèle est également facile à comprendre. Il se présente comme un outil vidéo rapide et cinématographique capable de transformer du texte ou des images en résultats soignés avec une sortie 1080p, de la narration multi-plans, et un audio optionnel. Cette combinaison est séduisante parce qu’elle parle directement comme pensent les créateurs : est-ce que cet outil va m’aider à produire des clips dynamiques, aboutis, et prêts à être publiés ?

En d’autres termes, la nouvelle n’est pas seulement qu’il est bien classé. La nouvelle, c’est qu’il est bien classé tout en restant nouveau, partiellement inexpliqué, et hautement testable. C’est une combinaison puissante sur le marché actuel de la vidéo IA.

Ce qui est réellement confirmé à propos de Happy Horse aujourd’hui

C’est là que l’histoire devient plus intéressante — et plus utile. La façon intelligente de regarder Happy Horse 1.0 consiste à séparer les informations publiques confirmées des spéculations.

Ce qui semble clair pour l’instant, c’est que le modèle a gagné une attention sérieuse dans les discussions de benchmarks actuelles et que son expérience côté utilisateur officiel est construite autour de l’accessibilité. La promesse est simple : tapez un prompt ou téléversez une image, générez un clip cinématographique, et faites-le avec le moins de friction possible.

Cela compte parce que beaucoup d’utilisateurs ne se soucient pas d’abord des diagrammes d’architecture ou des noms techniques. Ils se soucient de ce que l’outil leur permet de faire dans un navigateur. À ce niveau, Happy Horse 1.0 est présenté comme un modèle facile d’approche tout en visant un mouvement plus soigné, des transitions de scènes plus fluides, et une dramaturgie visuelle plus forte que de nombreux outils de génération rapide.

En même temps, l’ascension du modèle a déclenché plus de questions que de réponses. Qui se trouve derrière ? À quel point les résultats sont-ils stables selon les types de prompt ? Va-t-il conserver son élan actuel à mesure que davantage d’utilisateurs le testent dans plus de catégories ? Ces questions font aussi partie de l’histoire, et c’est précisément ce qui rend le modèle digne d’intérêt plutôt que simplement tendance.

Pourquoi Seedance 2.0 reste le modèle le plus pertinent pour la comparaison

Si Happy Horse 1.0 est la percée mystérieuse, Seedance 2.0 AI est l’alternative plus complètement expliquée.

Cela lui donne un type de force très différent. Au lieu de s’appuyer sur un buzz soudain, Seedance 2.0 AI bénéficie d’une identité produit plus claire. Il est positionné comme un système de création vidéo multimodal, avec prise en charge du texte, de l’image, de l’audio et des références vidéo. Cela le rend plus facile à comprendre non seulement comme un modèle qui génère de jolis clips, mais comme un modèle conçu pour les créateurs qui veulent davantage de direction, plus de contrôle, et plus de cohérence d’un projet à l’autre.

Cette différence est importante. Beaucoup d’utilisateurs occasionnels jugent un modèle à travers quelques exemples viraux, mais les créateurs sérieux regardent généralement la profondeur du workflow. Le modèle suit-il bien les références ? Aide-t-il à préserver la cohérence d’un personnage ou d’une scène ? Peut-il faire plus que produire un seul plan visuellement réussi ?

C’est pourquoi Seedance 2.0 video reste un point de comparaison aussi solide. Même si la vague de conversation actuelle penche vers la surprise Happy Horse, Seedance continue de séduire les utilisateurs qui veulent quelque chose de plus facile à intégrer dans une chaîne de production plus large.

Certains utilisateurs ont également découvert le modèle pour la première fois via des démos publiques et des intégrations de plateforme liées à Higgsfield Seedance 2.0, ce qui a renforcé sa réputation de plus qu’un simple nom de classement. Il donne l’impression d’un outil dont la place sur le marché est plus clairement définie.

Tableau : instantané de qualité actuel

Voici la manière la plus simple de comprendre la conversation en ce moment.

| Catégorie | Happy Horse 1.0 | Seedance 2.0 | Ce que cela suggère |

|---|---|---|---|

| Texte vers vidéo avec audio | 1229 | 1225 | Essentiellement au coude-à-coude |

| Texte vers vidéo sans audio | 1383 | 1273 | Happy Horse a l’avantage le plus net |

| Image vers vidéo avec audio | 1165 | 1164 | Presque une égalité |

| Image vers vidéo sans audio | 1413 | 1357 | Happy Horse mène à nouveau |

Ces chiffres expliquent pourquoi Happy Horse 1.0 est soudainement devenu central dans tant de discussions sur la vidéo IA. Dans les comparaisons à l’aveugle, il n’est pas seulement compétitif. Dans plusieurs catégories, il est en tête. Mais le tableau montre aussi autre chose : les catégories avec audio sont beaucoup plus serrées. Cela signifie que l’écart n’est pas un raz-de-marée uniforme dans chaque cas d’usage concret.

Tableau : comparaison de workflow pour les créateurs réels

Les victoires au classement sont excitantes, mais les utilisateurs ont généralement besoin de plus qu’un tableau de score. Ils doivent savoir quel modèle correspond à leur processus réel.

| Point de comparaison | Happy Horse 1.0 | Seedance 2.0 |

|---|---|---|

| Première impression | Le modèle surprise qui explose | L’option de workflow pro plus clairement positionnée |

| Récit produit public | Simple, cinématique, facile à tester | Plus structuré et riche en fonctionnalités |

| Style d’entrée | Axé texte et image dans l’usage orienté grand public | Texte, image, audio et références vidéo |

| Angle audio | Attractif mais encore en construction dans le récit public | Plus clairement intégré à l’identité du modèle |

| Meilleur usage | Expérimentations rapides, test de tendances, découverte | Création dirigée, workflows fortement basés sur des références |

| État d’esprit acheteur | « Je veux voir pourquoi tout le monde en parle » | « Je veux un modèle sur lequel je peux bâtir un processus reproductible » |

C’est à ce niveau que Seedance 2.0 AI continue de présenter un argument fort. Même lorsqu’un autre modèle remporte le cycle de buzz, un workflow plus clair peut rester le facteur décisif pour les professionnels.

Alors, quel modèle semble le plus utile aujourd’hui ?

La réponse honnête est qu’ils sont utiles de façons différentes.

Si vous êtes le type de créateur qui veut tester la nouveauté dont tout le monde parle, Happy Horse 1.0 est le choix de curiosité évident. Il a de l’élan, une promesse visuelle forte, et un profil de classement actuel qui donne envie de l’essayer soi-même.

Si vous êtes le type d’utilisateur qui valorise la répétabilité, un contrôle plus riche sur les entrées, et un système créatif plus structuré, Seedance 2.0 video peut toujours sembler l’option la plus sûre et la plus intelligente.

Cela ne fait pas de l’un « le vainqueur » en toutes choses. Cela signifie simplement que l’histoire est plus nuancée qu’un classement unique. Happy Horse 1.0 est le modèle qui porte la conversation du moment, tandis que Seedance 2.0 AI reste l’une des réponses les plus solides pour les utilisateurs qui veulent de la profondeur autant que de la qualité.

La leçon plus large pour les créateurs

La leçon la plus importante ici est que la vidéo IA entre dans une phase où des challengers surprenants peuvent changer la conversation presque du jour au lendemain. Un nouveau modèle n’a plus besoin d’une longue rampe de lancement pour compter. S’il offre de bonnes performances, les créateurs le remarqueront immédiatement.

Mais l’attention et la valeur à long terme ne sont pas toujours la même chose. L’histoire du jour, c’est Happy Horse 1.0, et c’est logique. Sa montée soudaine en fait l’un des développements les plus intéressants en vidéo IA à l’heure actuelle. Pourtant, la comparaison avec Seedance 2.0 video nous rappelle que la clarté publique, le contrôle multimodal et la stabilité du workflow comptent toujours autant que la hype.

Pour la plupart des lecteurs, la meilleure approche n’est pas de traiter cela comme une bataille de fans. Traitez-le comme une question pratique : voulez-vous explorer le modèle en pleine percée du moment, ou préférez-vous un système vidéo plus clairement défini avec une logique de production plus aboutie ?

C’est pour cela que cette comparaison est importante. Elle aide à transformer l’actualité de la vidéo IA en une véritable décision.

Recommandation des modèles et outils de VideoWeb

- Explorez VideoWeb AI pour un hub de création tout-en-un plus large.

- Essayez l’outil Image to Video pour une animation visuelle rapide et le test de tendances.

- Utilisez Text to Video lorsque vous voulez une génération vidéo centrée sur le prompt.

- Consultez la page dédiée Seedance 2.0 video pour un workflow plus orienté références.

Article connexe

- Seedance 2.0 Video Generation Guide: Tutorial + Prompts

- How to Use Seedance 2.0 for Anime Clips: Prompt Examples and Scene Ideas

- Sora 2 Is Shutting Down: The Best AI Video Alternatives for Creators Right Now