La parte más interesante del último debate sobre Gemini Omni no es simplemente que Google pueda tener otro modelo de vídeo con IA en marcha. Es lo que la actualización reportada sugiere sobre la siguiente etapa de la generación de vídeo: menos prompting aislado, más edición conversacional y un puente más fluido entre texto, imágenes, plantillas, sonido y vídeo finalizado.

Por ahora, Gemini Omni debería seguir tratándose como no confirmado. Google no ha lanzado públicamente un producto llamado Gemini Omni en el momento de escribir esto, y los creadores no deberían asumir precios oficiales, fecha de lanzamiento, acceso a API, regiones de despliegue, duración, resolución o límites de uso. La información actual de gemini omni latest info proviene de reportes sobre elementos de la interfaz de usuario de la app Gemini, salidas de demos tempranas y debate en torno a posibles conexiones con el ecosistema Veo de Google.

Eso hace que esto sea más que otra historia de “filtración de un modelo de IA”. Si los reportes son precisos, Gemini Omni podría apuntar hacia un nuevo tipo de flujo creativo en el que la generación de vídeo se convierte en algo que los usuarios refinan dentro de un chat, en lugar de una caja de prompt de una sola vez. Para creadores, marketers, educadores y observadores del vídeo con IA, ese cambio podría importar tanto como la calidad visual en bruto.

Última información de Gemini Omni: ¿Qué ha cambiado realmente?

El detalle clave reportado es que algunos usuarios vieron en Gemini un texto del estilo de “Crear con Gemini Omni”. Los reportes lo describen como una función de Gemini centrada en vídeo, con lenguaje sobre remezclar vídeos, editar directamente en el chat, probar plantillas y empezar a partir de una idea.

Ese texto es importante porque sugiere que la gemini omni video generation podría estar diseñada como un flujo de trabajo, no solo como un motor de renderizado. Las herramientas de vídeo con IA más antiguas suelen pedir al usuario que escriba un prompt, genere un clip, inspeccione el resultado y luego reescriba manualmente el prompt para intentarlo de nuevo. Un flujo nativo de Gemini podría hacer que el proceso se sienta más como: “haz esto más luminoso”, “convierte esto en un anuncio de producto”, “sustituye el fondo”, “prueba una versión vertical” o “remezcla esto con estilo documental”.

Aun así, la frontera entre lo conocido, lo reportado y lo desconocido importa. Lo que parece conocido es que los reportes actuales describen que Gemini Omni aparece dentro de Gemini. Lo que se reporta es que podría admitir creación basada en chat, remezcla, edición y plantillas. Lo que sigue siendo incierto es si google gemini omni video es un modelo nuevo, una función basada en Veo, una capa de interfaz de Gemini o un experimento interno que se mostró accidentalmente antes de un anuncio.

El cambio más grande: generación de vídeo dentro del flujo de trabajo del chat

Si Gemini Omni se convierte en realidad, su mayor contribución podría ser cambiar cómo los creadores interactúan con el vídeo con IA. La generación de vídeo a menudo se ha sentido como una tragaperras: escribes un prompt, esperas, confías en que el modelo entienda la escena y repites. Ese enfoque es potente, pero es lento cuando los usuarios necesitan precisión.

Un sistema conversacional cambia el ritmo. En lugar de reconstruir el prompt desde cero, un creador podría describir la corrección en lenguaje normal. Un marketer podría pedir tres variaciones de una presentación de producto. Un profesor podría solicitar un explicador en pizarra con texto más claro. Un creador social podría convertir un clip horizontal en un short vertical con un primer segundo más rápido.

Por eso gemini video AI importa como concepto. El futuro no es solo “mejores píxeles”. Es que la generación de vídeo se convierta en una conversación creativa. Refinamiento de prompts, referencias de imagen, plantillas, remezclas, dirección de audio e instrucciones de edición pueden pasar a formar parte de un único flujo de ida y vuelta.

Eso también haría el vídeo con IA más accesible. Muchos usuarios entienden lo que quieren pero no saben cómo escribir un prompt de nivel producción. Una interfaz de chat puede traducir la intención creativa a instrucciones técnicas de generación y luego ayudar a revisar el resultado.

Lo que las demos tempranas sugieren sobre la futura calidad del vídeo con IA

Según los reportes, las demos tempranas de Gemini Omni prueban dos categorías difíciles: escenas educativas e interacciones sociales realistas. Ambas son útiles porque revelan debilidades que los clips simples de paisajes cinematográficos pueden ocultar.

Un vídeo educativo estilo pizarra es difícil porque requiere estabilidad de escena, escritura legible, coordinación de manos y continuidad lógica. Si un profesor está escribiendo demostraciones trigonométricas, el modelo debe evitar que el texto de la pizarra se disuelva en sinsentidos y, al mismo tiempo, hacer que el movimiento de la mano resulte creíble. Los reportes sugieren que la salida se veía sorprendentemente coherente, aunque no libre de señales típicas de IA.

La demo tipo restaurante es una prueba de estrés distinta. Las escenas de cena incluyen manos, platos, cubiertos, comida, caras, conversación y contacto entre objetos. Esos detalles son difíciles para cualquier AI video generator porque el modelo debe entender relaciones físicas a lo largo del tiempo. Problemas reportados como objetos que aparecen de forma extraña, lógica de comer débil o contacto inconsistente no son detalles menores; son exactamente donde el vídeo con IA aún tropieza.

Las señales prometedoras son movimiento más realista, mejor composición de escena, manejo más limpio del texto, comprensión más sólida del prompt e iteración creativa más fluida. Los problemas restantes son igual de claros: manos, contacto entre objetos, escenas de comida, lógica física, barreras de seguridad, acceso por fases y posibles restricciones de uso. Hasta que existan benchmarks públicos y pruebas de creadores, Gemini Omni debería valorarse como una señal prometedora, no como un reemplazo probado de las herramientas actuales.

Gemini Omni vs Veo 3.1: ¿Modelo nuevo, interfaz nueva o capa de flujo de trabajo?

La mayor pregunta es cómo se relaciona Gemini Omni con Veo. Google ya tiene una vía oficial sólida para la generación de vídeo a través de Veo 3.1, así que sería prematuro asumir que Omni lo reemplaza.

Hay tres posibilidades realistas. Primero, Gemini Omni podría ser un modelo nuevo. Eso lo convertiría en un sistema de generación distinto, construido para el entorno multimodal de Gemini. Segundo, podría ser una interfaz nativa de Gemini alrededor de una generación tipo Veo, donde la tecnología del modelo se mantiene cercana a Veo pero la experiencia de usuario se vuelve más conversacional. Tercero, Gemini Omni podría ser una capa de flujo de trabajo: una forma de crear, editar, remezclar y usar plantillas dentro de Gemini mientras utiliza por debajo modelos de vídeo de Google existentes o en evolución.

Veo 3.1 aporta contexto útil porque Google ya ha enfatizado adherencia al prompt, dirección de audio nativa, control cinematográfico, generación de imagen a vídeo, flujos basados en referencias y mejor calidad audiovisual. El Veo 3.1 video model es actualmente el benchmark oficial más claro de la estrategia de vídeo de Google.

Eso significa que la pregunta correcta no es solo “Gemini Omni vs Veo 3.1”. También es si Gemini Omni representa una nueva interfaz para las mismas ambiciones creativas: mejor control, revisión más rápida, escenas más coherentes y menos fricción entre idea y resultado.

Qué deberían vigilar los creadores a continuación

Los creadores deberían vigilar cinco detalles prácticos antes de tomar cualquier decisión de flujo de trabajo. El primero es el calendario de lanzamiento. Gemini Omni podría aclararse en torno a una ventana de anuncio tipo Google I/O, pero ningún creador debería planificar en torno a fechas basadas en rumores.

El segundo es el acceso. ¿Aparecerá en Free, Pro, Ultra o en un nivel aparte? ¿Estará disponible globalmente o solo en regiones seleccionadas? ¿Lo recibirán primero los usuarios móviles o importarán más los flujos de escritorio?

El tercero es el costo y los límites. Generar vídeo con IA es caro, así que incluso una función potente puede venir con cuotas estrictas. Las capturas de pantalla reportadas sobre límites de uso son señales útiles, pero no son reglas oficiales del producto.

El cuarto es la profundidad de capacidades. Los creadores deberían buscar soporte de audio, imágenes de referencia, fotogramas de inicio/fin, plantillas, edición, extensión de vídeo, continuidad multitoma y si las revisiones basadas en chat preservan la identidad de personajes, productos y escenarios.

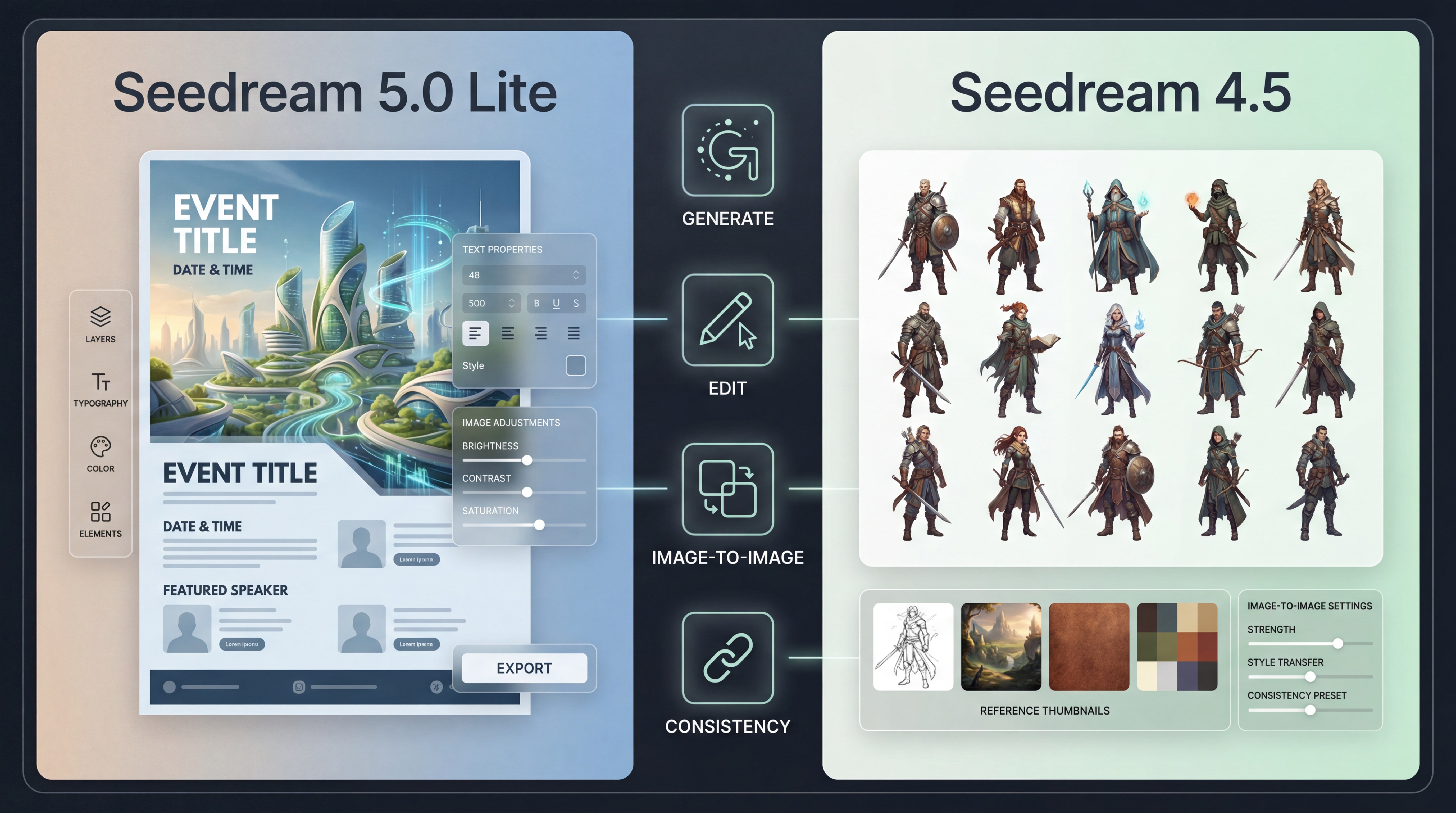

El quinto es la competencia. Gemini Omni acabará comparándose con flujos de trabajo de Sora, Seedance, Kling, Wan y Veo. La prueba real no será una sola demo. Será si el sistema puede sostener creación repetible de anuncios en vídeo, vídeos educativos, demos de producto, clips sociales y hábitos de creador a largo plazo.

Cómo prepararse ahora con VideoWeb AI

Mientras Gemini Omni siga sin confirmarse, los creadores aún pueden prepararse practicando los hábitos que se transfieren entre modelos. La mejor preparación no es memorizar una función rumoreada. Es aprender a estructurar prompts, controlar fotogramas de referencia, comparar modelos, probar interacción entre objetos y revisar escenas con intención.

VideoWeb AI es útil aquí porque puede servir como un espacio de trabajo independiente para la experimentación actual con vídeo con IA. No debería describirse como oficialmente afiliado a Google a menos que eso esté confirmado. Su valor práctico es que los creadores pueden probar flujos modernos hoy mientras observan hacia dónde van Gemini Omni y Veo.

Para pruebas amplias, el VideoWeb AI video generator ayuda a los usuarios a comparar distintas direcciones creativas sin encadenar todo el proceso a un solo modelo. El hub de AI video generation workflow es útil para pensar el recorrido completo desde el concepto al prompt, a la elección del modelo y a la revisión del resultado.

Para hábitos de producción, un image to video AI generator ayuda a los creadores a practicar animación basada en referencias, mientras que un text to video AI generator es mejor para la narrativa primero basada en guion. Los creadores que sigan el tipo de salida de Google pueden probar el Google Veo 3.1 AI video generator como benchmark actual. Para comparar, el Seedance 2.0 AI video generator y el Kling 2.1 Master video generator pueden ayudar a los usuarios a entender cómo distintos modelos manejan el movimiento, la lógica de escena y el estilo cinematográfico.

Conclusión

Gemini Omni podría importar porque apunta hacia la generación de vídeo conversacional y multimodal. La actualización reportada no trata solo de generar clips más bonitos; trata de hacer que la creación de vídeo se sienta más como un diálogo creativo iterativo dentro del chat.

Pero los detalles no son definitivos. Gemini Omni no ha sido confirmado oficialmente como un producto público, y los creadores deberían esperar al anuncio de Google antes de confiar en afirmaciones sobre acceso, precio, límites de uso, especificaciones o soporte de API. Lo práctico es vigilar actualizaciones oficiales, comparar salidas reales cuando estén disponibles y usar VideoWeb AI para practicar ahora flujos de trabajo actuales de generación de vídeo. La próxima ola de modelos recompensará a los creadores que ya entienden prompting, referencias, movimiento, objetivos de edición y comparación de modelos.

Ejemplos de prompts para probar flujos de trabajo de generación de vídeo al estilo Gemini

-

Prompt de edición de vídeo conversacional Subject: un teaser de producto de 10 segundos para una lámpara de escritorio inteligente. Scene: espacio de trabajo moderno con portátil, cuaderno y reflejos suaves. Camera motion: lento avance (push-in), luego un primer plano de la lámpara encendiéndose. Lighting: luz cálida de escritorio al atardecer con un sutil brillo azul de fondo. Action: primero genera la revelación limpia del producto y luego revísala haciendo la escena más premium, ralentizando la cámara y añadiendo una tarjeta de título final. Audio: ambiente electrónico suave. Quality goal: forma del producto estable y ritmo cinematográfico de anuncio. Negative notes: evita geometría deformada del producto, texto ilegible, sombras parpadeantes o reflejos inestables.

-

Prompt educativo de explicador en pizarra Subject: un profesor de matemáticas tranquilo explicando una identidad trigonométrica. Scene: aula tradicional con una gran pizarra. Camera motion: plano medio con un lento dolly-in. Lighting: luz diurna suave desde ventanas laterales. Action: el profesor escribe una ecuación a la vez y señala cada paso mientras explica. Audio: voz clara, leves sonidos de tiza, ambiente silencioso de aula. Quality goal: escritura legible y movimiento de mano creíble. Negative notes: evita símbolos ilegibles, manos deformadas, trazos de tiza que no coincidan o texto que desaparece.

-

Prompt de vídeo demo de producto Subject: un frasco premium de cuidado de la piel. Scene: encimera de baño de mármol con gotas de agua y reflejos suaves en el espejo. Camera motion: órbita macro seguida de un plano cenital (top-down) hero. Lighting: luz limpia de mañana con brillos suaves. Action: el frasco gira ligeramente, aparece una pequeña cantidad de crema en la yema de un dedo y se desvanece (fade in) una breve etiqueta de beneficio. Audio: ambiente suave de agua y tono refinado de revelación de producto. Quality goal: look de comercial de lujo. Negative notes: evita que cambie el texto de la etiqueta, forma inestable del frasco, dedos distorsionados o contacto entre objetos roto.

-

Prompt de movimiento cinematográfico de imagen a vídeo Subject: anima el retrato o imagen de producto proporcionada preservando la identidad. Scene: mantén el fondo y la paleta de color originales. Camera motion: parallax dolly-in sutil con separación de profundidad suave. Lighting: mantiene la dirección de luz de la imagen fuente. Action: añade pequeños movimientos naturales como luces parpadeantes, partículas a la deriva, movimiento de tela o brisa ambiental. Audio: ambiente cinematográfico bajo. Quality goal: preservar la imagen original mientras se le da vida. Negative notes: evita cambiar la identidad facial, colores, ubicación del logo o proporciones del producto.

-

Prompt de anuncio social de formato corto Subject: un creador haciendo un unboxing de auriculares inalámbricos. Scene: vertical 9:16, setup de escritorio en dormitorio con acentos LED coloridos. Camera motion: toma gancho rápida, corte a primer plano y luego toma de reacción con cámara en mano. Lighting: iluminación brillante estilo creador con acentos neón. Action: el creador abre la caja, muestra los auriculares, toca el teléfono y reacciona al sonido. Audio: música upbeat de formato corto con sonidos sutiles del embalaje. Quality goal: ritmo listo para TikTok/Reels. Negative notes: evita cortes caóticos, manos distorsionadas, texto de UI ilegible u objetos flotando.

-

Prompt de prueba de comparación de modelos Subject: dos personas comiendo pasta en un restaurante al aire libre junto al mar. Scene: mesa circular con platos, tenedores, vasos, servilletas y fondo del océano. Camera motion: primer plano lento con cámara en mano moviéndose entre manos, comida y rostros. Lighting: atardecer de hora dorada. Action: una persona enrolla la pasta, da un bocado y continúa la conversación mientras la otra levanta una copa. Audio: olas suaves, cubiertos, conversación tenue. Quality goal: probar contacto entre objetos, lógica al comer, consistencia facial y realismo de escena. Negative notes: evita contacto entre objetos roto, comida que desaparece, dedos deformados, platos inestables o masticación irreal.

Herramientas / APIs / Modelos recomendados

- VideoWeb AI — Lo mejor para creadores que quieren un espacio de trabajo práctico para explorar flujos de vídeo con IA mientras siguen de cerca los desarrollos de Gemini Omni y Veo.

- AI Video Generator — Lo mejor para pruebas generales de vídeo con IA, experimentos creativos y comparaciones rápidas entre modelos.

- AI Video Generator Workflow Hub — Lo mejor para planificar un flujo completo de generación de vídeo con IA desde el concepto hasta la revisión del resultado.

- Image to Video AI Generator — Lo mejor para animar fotos de producto, arte de personajes, imágenes de campaña y fotogramas de storyboard.

- Text to Video AI Generator — Lo mejor para convertir guiones, ideas de anuncios, explicadores y descripciones de escenas en clips generados.

- Google Veo 3.1 AI Video Generator — Lo mejor para creadores que quieren estudiar el estilo de salida de Google y los flujos de Veo 3.1.

- Seedance 2.0 AI Video Generator — Lo mejor para comparar movimiento, interpretación del prompt y alternativas de generación de vídeo de formato corto.

- Kling 2.1 Master Video Generator — Lo mejor para probar realismo cinematográfico, movimiento de personajes y generación de vídeo estilizada.

Artículos relacionados

- VideoWeb AI Video Generator 2026: One Hub, Every AI Video Workflow

- How to Create Better TikTok Videos with Google Veo 3.1 on VideoWeb

- Veo 3.1 API Guide: How to Use Google’s Premium Video Model on Flaq AI

- Sora 2 Is Shutting Down: The Best AI Video Alternatives for Creators Right Now

- Christmas Video Magic with Nano Banana Pro & Veo 3.1: The Complete Prompt Guide for Holiday Creators

La gente también lee

- Veo 3.1 Guide: Better Prompts, Settings, and Fixes

- How to Use HeyDream AI’s Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows

- The Release of Seedance 2.0: What Dropped, What’s New, and What Creators Should Do Next

- Wan 2.7 Review and Comparison: What Changed, What Matters, and What Creators Should Use

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- How to Use the AI Music Video Generator: A Detailed Guide from Song to Video