OpenAIs neueste Bildversion ist schnell zu einem der meistdiskutierten Meilensteine in der kreativen KI geworden. Zwischen der offiziellen Produktankündigung und der Entwicklerdokumentation begegnen Nutzer mehreren Bezeichnungen für das, was sich wie derselbe große Fortschritt anfühlt. Deshalb suchen viele nach Begriffen wie GPT Image 2, OpenAI image 2.0 und OpenAI GPT Image 2 gleichzeitig.

Kurz gesagt: OpenAIs neuer Bild-Stack konzentriert sich auf bessere Bildqualität, stärkeres Befolgen von Prompts, sauberere Textrenderings innerhalb von Bildern und zuverlässigere Bearbeitung. In der offiziellen Ankündigung wird die nutzerorientierte Oberfläche als ChatGPT Images 2.0 vorgestellt. In der Entwicklerdokumentation wird das zugrunde liegende API-Modell als gpt-image-2 beschrieben. Für Alltagsnutzer ist die wichtigste Frage allerdings weniger die Benennung, sondern die Ergebnisse: Was ist jetzt tatsächlich besser – und wo kann man es ausprobieren?

Warum sich GPT Image 2 wie ein bedeutendes Release anfühlt

Die KI-Bildgenerierung hat bereits mehrere Wellen durchlaufen. Die erste Welle beeindruckte durch Stil. Die zweite Welle machte die Bildproduktion schneller und einfacher. Diese neue Welle dreht sich um Kontrolle. Das ist der eigentliche Grund, warum GPT Image 2 von OpenAI so viel Aufmerksamkeit auf sich zieht.

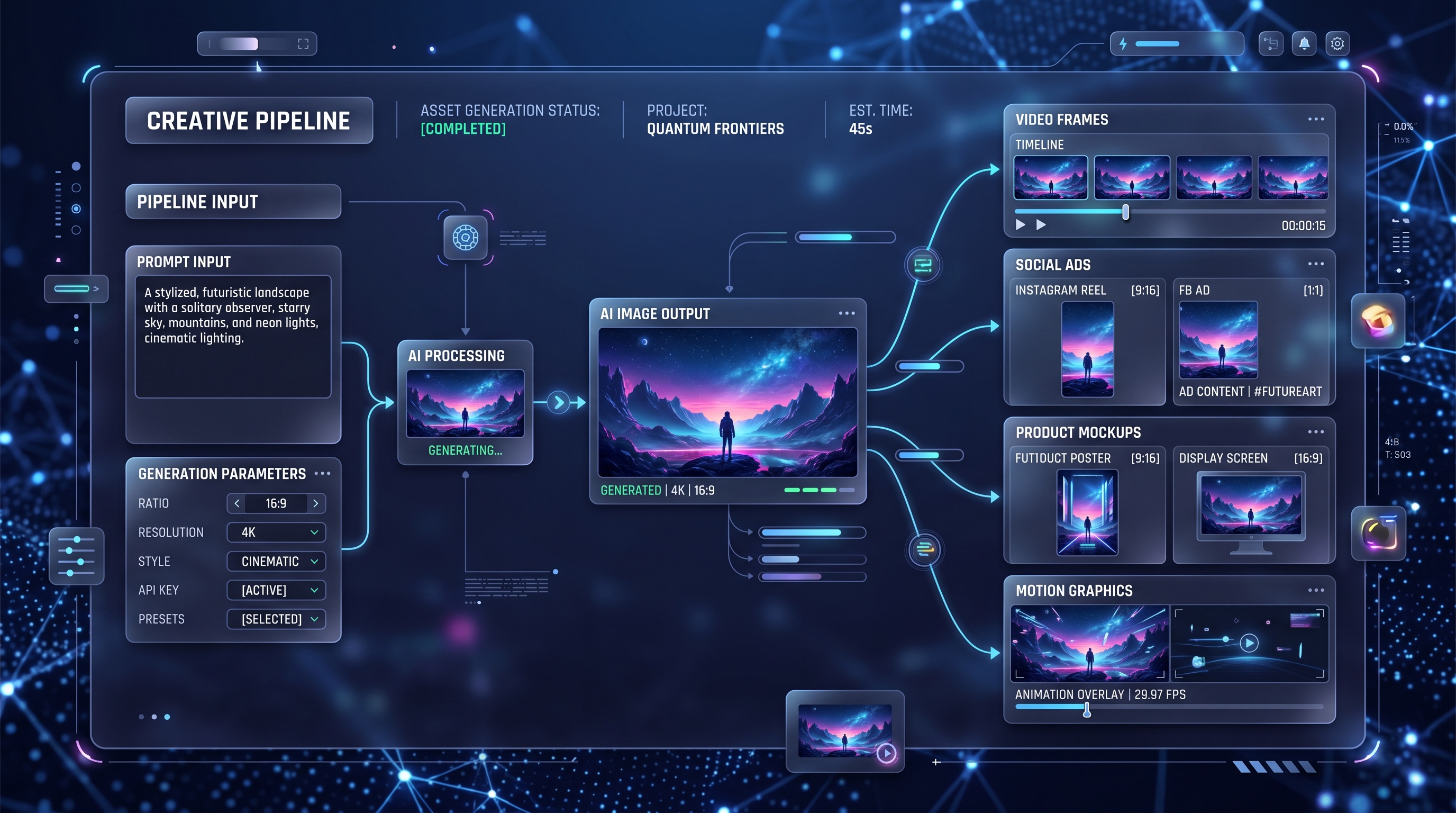

Anstatt Bildgenerierung als einmaliges Kunstwerkzeug zu behandeln, treibt OpenAI sie in Richtung eines praktischeren kreativen Workflows. Man kann es für Poster, Social-Creatives, Mockups, Mangaseiten, Konzeptkunst, UI-ähnliche Kompositionen, Referenzbögen und Bildbearbeitungen nutzen, die klarere Anweisungen erfordern. Mit anderen Worten: Es geht nicht nur um „Mach ein hübsches Bild“, sondern um „Mach das Bild, das ich tatsächlich beschrieben habe“.

Dieser Wandel ist für Kreative, Marketer, Designer und Entwickler gleichermaßen relevant. Bessere Kontrolle bedeutet in der Regel weniger misslungene Generierungen, weniger umständliche Korrekturschleifen und einen deutlich reibungsloseren Weg von der Idee zum nutzbaren Ergebnis.

Was in GPT Image 2 tatsächlich neu ist

Die größte Verbesserung ist das Textrendering. Über Jahre hinweg waren KI-Bilder visuell beeindruckend, aber unzuverlässig, wenn es darum ging, lesbare Wörter in Poster, Menüs, Etiketten, Schilder, Magazintitel oder produktartige Layouts einzufügen. Mit OpenAI GPT Image 2 wirkt genau dieser Teil deutlich besser nutzbar.

Die zweite große Verbesserung ist die mehrsprachige Leistungsfähigkeit. Das ist wichtiger, als es auf den ersten Blick scheint. Ein Modell, das mehrere Schriftsysteme sauberer handhabt, ist für globales Marketing, Bildung, Storytelling und Branding deutlich nützlicher.

Die dritte Verbesserung ist ein besseres Befolgen von Anweisungen. Hier beginnt sich das Modell weniger wie ein Glücksspielautomat und mehr wie ein kreativer Assistent anzufühlen. Wenn man eine Szene mit bestimmter Stimmung, Komposition, einem bestimmten Seitenverhältnis und einem Set an Designelementen verlangt, versucht das Modell in der Regel, mehr dieser Vorgaben gleichzeitig zu respektieren.

Außerdem gibt es ein stärkeres Layout-Bewusstsein. Dadurch wird dieses Release relevanter für Menschen, die Coverkonzepte, Anzeigentwürfe, Präsentationsvisuals, Storypanels, Menüs, Poster oder Produktmockups erstellen. Es ist leichter vorstellbar, dieses Modell in echten Content-Pipelines einzusetzen, statt nur in experimentellen Kunst-Threads.

Schließlich spielt die Bearbeitung jetzt eine größere Rolle. OpenAI behandelt Bildgenerierung und Bildtransformation ganz offensichtlich als Teile desselben Workflows. Das macht das Release praktischer für alle, die von einem Referenzbild ausgehen, Details überarbeiten oder sich schrittweise auf ein finales Asset zubewegen wollen, statt jedes Mal bei Null zu beginnen.

Warum sich dieses Release von älteren OpenAI-Bildworkflows abhebt

Was dieses Update anders wirken lässt, ist nicht nur ein bestimmter Benchmark oder ein spektakuläres Beispiel, sondern das Gesamterlebnis. Frühere KI-Bildtools zwangen Nutzer oft dazu, zwischen schönen Visuals und präziser Ausführung zu wählen. Man bekam vielleicht ein großartiges Bild, aber der Text war unbrauchbar, das Layout driftete weg oder die Szene ignorierte die Hälfte des Prompts.

Die neue Ausrichtung des chatgpt image model wirkt hilfreicher, weil sie einen Teil dieser Lücke schließt. Sie versucht, visuelle Qualität mit stärkerem Prompt-Following, Bearbeitungsunterstützung und einem stimmigeren Aufbau zu kombinieren.

Das ist besonders für Nicht-Künstler wichtig. Viele Menschen, die diese Tools nutzen, sind keine Illustratoren. Es sind Gründer, Content Creator, Lehrer, Marketer, Indie-Entwickler und Kleinunternehmer. Sie brauchen keine endlosen Stil-Experimente. Sie brauchen etwas, das ein Hero-Image, ein Menüboard, eine Comicseite, ein Thumbnail-Konzept oder ein Produktvisual generieren kann, ohne mit ihnen „zu kämpfen“.

Wo man GPT Image 2 offiziell nutzen kann

Wer den offiziellen Weg gehen möchte, hat zwei Hauptzugänge.

Der erste ist die Produktseite von OpenAI, wo das Release als ChatGPT Images 2.0 präsentiert wird. Das ist für allgemeine Nutzer das einfachste mentale Modell: OpenAI hat die Bilderfahrung im eigenen Ökosystem verbessert, insbesondere beim Textrendering, bei der mehrsprachigen Ausgabe, bei Seitenverhältnissen und bei der kreativen Kontrolle.

Der zweite Weg führt über die Entwicklerseite. In OpenAIs Dokumentation wird gpt-image-2 als aktuelles Bildgenerierungsmodell für schnelle, hochwertige Bildgenerierung und -bearbeitung vorgestellt. Es ist über die OpenAI-Plattform für Entwickler verfügbar, die Bildfunktionen in Apps und Workflows integrieren wollen.

Darum ist das Suchinteresse an Begriffen wie chatgpt image api gestiegen. Menschen wollen wissen, ob diese neue Generation von OpenAI-Bildtools nur ein Konsumenten-Feature ist oder auch in Produkte eingebaut werden kann. Die Antwort: OpenAI unterstützt klar sowohl nutzerorientierte als auch entwicklerorientierte Zugänge.

Wo man jetzt eine einfache Web-Variante nutzen kann

Für viele sind offizielle Dokumentationen zwar hilfreich, um das Release zu verstehen, aber nicht unbedingt, um tatsächlich etwas zu erstellen. Sie möchten eine einfache Oberfläche, in der sie Prompts schnell testen, Ergebnisse vergleichen und weitermachen können.

Hier kommt VideoWeb ins Spiel. Die GPT image 2 OpenAI-Landingpage ist als einfache, browserbasierte Bildgenerierungsoberfläche positioniert, die auf dem GPT-4o-Bildworkflow aufbaut. Für Gelegenheitsnutzer ist dies oft der praktischere Einstieg: Bild beschreiben, Einstellungen anpassen, generieren und iterieren.

Dieser Zugang ist wichtig, weil Bequemlichkeit darüber entscheidet, wie oft Menschen ein Modell tatsächlich nutzen. Ein leistungsstarkes Modell, das hinter technischer Hürde versteckt ist, bleibt für Mainstream-Nutzer meist theoretisch. Eine klare Oberfläche senkt diese Barriere.

Wer sich GPT Image 2 genauer ansehen sollte

Dieses Release ist besonders für einige Gruppen relevant.

Kreative sollten hinschauen, weil textlastige Visuals, Thumbnails, Posterentwürfe und Social-Grafiken zu realistischeren Anwendungsfällen werden. Designer sollten hinschauen, weil Layout-Disziplin und Bearbeitung nun verlässlicher wirken. Marketer sollten hinschauen, weil klarere Typografie und besseres Befolgen von Anweisungen Kampagnenentwürfe deutlich einfacher prototypisierbar machen. Entwickler sollten hinschauen, weil OpenAI Bildgenerierung als ernstzunehmende Produktfähigkeit behandelt – nicht nur als Spielerei.

Und auch ganz normale Nutzer sollten hinschauen. Wer das Gefühl hatte, dass KI-Bildtools zwar unterhaltsam, aber unzuverlässig sind, sieht in diesem Release einen Schritt in eine praktischere Richtung.

Das größere Fazit

Das Wichtigste an diesem Launch ist nicht das exakte Label. Manche werden es GPT Image 2 nennen. Andere sagen OpenAI image 2.0. Wieder andere denken einfach an die neueste Bildengine von ChatGPT. Die Namen mögen variieren, aber die Kernbotschaft ist klar: OpenAI treibt Bildgenerierung in Richtung höherer Nützlichkeit, nicht nur höherer Neuartigkeit.

Das bedeutet besseren Text, mehr Kontrolle, bessere mehrsprachige Ausgaben, flexiblere Kompositionen und eine praktikablere Brücke zwischen Generierung und Bearbeitung. Wenn sich dieser Trend fortsetzt, werden Bildmodelle zunehmend zu alltäglichen Produktionstools statt gelegentlichen Kreativspielzeugen.

Für Nutzer, die das Release verstehen wollen, sind die offiziellen OpenAI-Seiten der beste Ort, um Verifiziertes nachzulesen. Für Nutzer, die einen schnellen Web-Workflow ausprobieren möchten, ist GPT Image 2 auf VideoWeb ein praktischer nächster Schritt. Und für alle, die Ökosysteme vergleichen, lohnt sich ein Blick auf den breiteren Bild- und Video-Stack von VideoWeb.

Empfohlene Tools und Modelle auf VideoWeb

- GPT-4o Image Generator

- AI Image Generator

- Seedream 4.5 AI

- Nano Banana Pro AI

- Qwen Image 2

- Seedance 2.0

- Google Veo 3.1

- Vidu Q3

- Kling 3.0

- Image to Video

Verwandter Artikel

- Mastering GPT4o Image Generation: How to Unlock Creative Potential with the New GPT 4o Image Generator

- How to Use Seedance 2.0 for Anime Clips: Prompt Examples and Scene Ideas

- Vidu Q3 AI vs Kling 3.0: Which AI Video Model Should You Use on VideoWeb AI?

Nutzer lesen auch

- HeyDream AI Image Generator Guide: Best Models for Text-to-Image and Image-to-Image

- Nano Banana Pro on DreamMachine AI: A Practical Way to Create Better AI Images

- How to Use Sea Imagine AI's Image Generator: A Beginner-Friendly Tutorial

- AIFacefy AI Image Generator 2026: Best Models Ranked + When to Use Each

- GPT Image 2: What’s New, What’s Confirmed, and Why Creators Are Watching Closely

- GPT Image 2 Explained: What’s New, and How It Compares With Nano Banana Pro